2. 北京信息科技大学 北京材料基因工程高精尖创新中心, 北京 100101;

3. 北京信息科技大学 计算机学院, 北京 100101

2. Beijing Advanced Innovation Center for Materials Genome Engineering, Beijing Information Science and Technology University, Beijing 100101, China;

3. School of Computer, Beijing Information Science and Technology University, Beijing 100101, China

随着人工智能和大数据技术的逐渐成熟和快速发展,数据成为一种稀缺资源。很多研究机构和科技型企业因缺少数据,由此严重阻碍了其业务的开展。为鼓励和支持大数据的发展,2015年9月5日,我国政府颁布了《促进大数据发展行动纲要》,其中明确提出要在依法加强安全保障和隐私保护的前提下,稳步推动公共数据资源开放,形成政府数据统一开放平台。通过制定公共机构数据开放计划,建立政府部门和事业单位等公共机构数据资源清单,并制定实施政府数据开放共享标准与数据开放计划。

由于大数据中包含大量有关个人的隐私信息,如果不能对数据进行有效管理和利用,则不可避免地会造成隐私数据的泄露,给相关人员带来负面影响和伤害,不仅会引发法律纠纷,而且也将严重制约大数据和人工智能技术的快速发展与广泛应用。因此,对数据进行隐私保护是一个不容忽视的问题。

本文构建一个隐私保护模型,该模型根据用户身份和数据用途判定用户安全等级,确定对应的匿名化方案和初始隐私参数,判断是否能够同时满足数据发布方的隐私保护要求以及数据使用方对数据可用性的要求,按确定的方法和参数进行隐私保护处理并发布数据。

1 相关工作在数据隐私保护领域,研究工作主要面向访问者的隐私保护策略和面向数据本身的隐私保护技术两个方面。面向访问者的隐私保护策略中最常用的解决方案为基于角色或目的的访问控制策略[1-2]。目的是防止非法用户进入系统,以及合法用户对系统资源的非法使用,从而保证数据中的隐私不被泄露。

面向数据本身的隐私保护技术,依据实现方法的不同大致分为干扰和转换方法[3-4]、匿名化方法[5-7]、安全多方计算方法[7-8]和基于以上几种方法的混合方法[9]等。

干扰和转换方法的基本思想是通过加入噪声数据来保护真实数据。一方面确保不会泄露用户的隐私,另一方面使得这些被修改后的数据仍可用于统计分析。由于该方法对原始数据进行了修改,因此不能很好地支持查询统计等需求。

匿名化方法因为其显著的安全性和有效性而得到了更为广泛的应用,目前已发展成为一系列的方法。其中,最著名的方法是k-anonymity方法[10]。该方法是由SWEENEY等人于1998年提出的,可以有效地阻止链接攻击。然而,k-anonymity方法存在以下缺陷:当一个分组中的所有记录拥有同一个敏感属性值时,攻击者就可以轻易获得隐私信息。

为解决分组中含有同种敏感属性值的问题,MACHANAVAJJHALA等人于2006年提出了l-diversity方法[11],有效解决了k-anonymity方法所存在的链接攻击问题,但该方法无法抵挡相似性攻击,即某一敏感属性值占比过大的情况。在这种情况下,攻击者仍有较高的概率可以推出个体隐私。随后LI等人提出了t-closeness方法[12],它要求分组中敏感属性值的分布和数据表中的分布是近似的,由此可以解决l-diversity方法所存在的相似性攻击问题。

在实际应用中,动态数据发布比较普遍,但是当对数据表中增加新的数据后,可能会导致对数据表做的匿名保护被破坏,从而泄露隐私。因此,需要对增量数据进行匿名化处理。文献[13]提出了支持连续发布数据表的插入更新匿名模型。在每个发布的数据表满足l-diversity约束的前提下,新的记录如果满足l-diversity约束,则可以直接插入原表,否则将记录分别插入到已有的信息损失最小等价类中。

此外,针对多维敏感属性的情况,文献[14-15]提出了多维桶分组发布(Multi-Sensitive Bucketization,MSB)模型,以解决多维敏感属性数据的匿名化问题,该方法的解决主要是根据敏感属性值来构建多维桶,每个桶中映射多个记录,再根据不同的选择策略在不同的桶中提取记录,从而形成分组。在提取记录时,尽量从不同的桶中提取记录,使得单个维度上每条记录的敏感值都不相同。

综上所述,尽管出现了一些新的隐私保护方法,但到目前为止,经典的隐私保护方法当属隐私保护程度呈逐级递增的k-anonymity、l-diversity和t-closeness 3种方法,但3种方法对数据的破坏程度也是逐级递增的[16]。其中,k-anonymity方法对数据的改动最少,数据可用性最好,但隐私效果最差;t-closeness方法的隐私保护效果最好,但对数据改动很大,可用性也是最差的;l-diversity方法的数据改动性和可用性处于中游。如何针对不同的隐私保护需求,科学、合理地选取最恰当的方法,并自动找到最优的参数,还没有实际可应用的成果。因此,如何选取最合适的方法与参数,使得进行隐私保护处理后的数据既可以达到数据提供者所希望的隐私保护效果,又能够满足数据使用者的可用性要求,是非常值得研究的[17-19]。

本文的创新点如下:

1)提出了一个面向数据发布的隐私保护模型,通过该模型不仅可以选择最适合的隐私保护方法,而且还可以优选对应的隐私保护参数,既可以达到数据提供者所期望的隐私保护效果,又能够满足数据使用者对可用性的要求。

2)给出了k-匿名隐私保护算法中的k参数、l-多样性隐私保护算法中的l参数以及t-闭合隐私保护算法中的t参数的优选方法,从而为用户确定这些参数提供了便利。

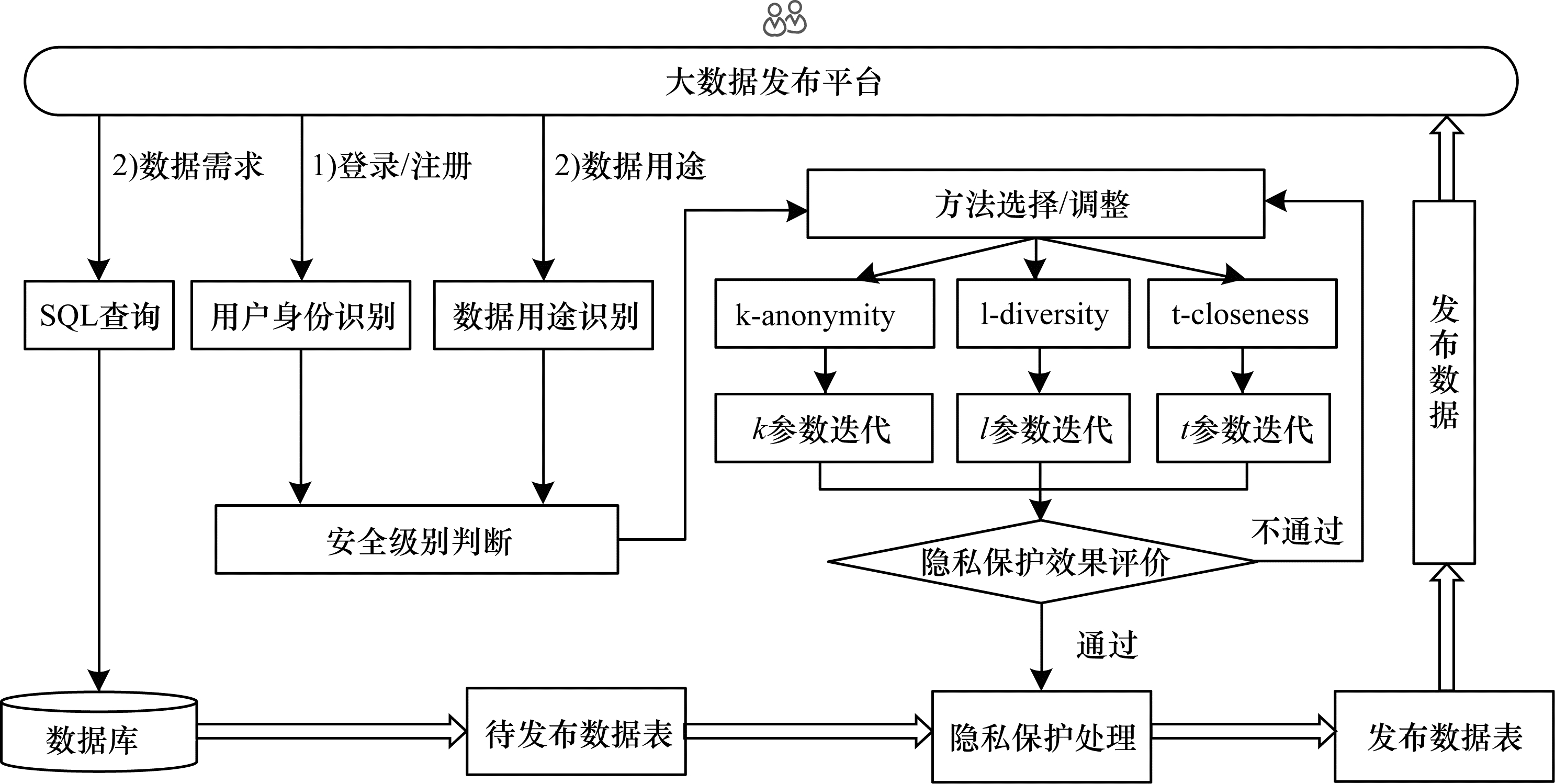

2 大数据发布隐私保护模型本文数据隐私保护模型如图 1所示。

|

Download:

|

| 图 1 大数据发布隐私保护模型 Fig. 1 Big data dissemination privacy protection model | |

从图 1可以看出,用户首先进行登录/注册,系统识别用户身份,然后提交自己的数据需求范围和数据用途说明,数据层接收到用户的数据需求后,执行SQL查询语句,检索出用户所需要的数据。安全等级判断模块则根据用户的身份和数据的用途为用户确定安全等级,并将等级信息传递给隐私保护处理部分。隐私保护处理部分根据用户的安全等级在隐私保护程度不同的3种匿名化方法中为其选择合适的匿名化方法。确定匿名化方法后,再针对该方法进行初始参数选取。然后根据数据提供方的隐私保护要求进行效果评价,若不满足要求则进行参数调整,如果参数调整无效则进行方案调整。每次调整完成后,重新进行隐私保护效果评估。参数调整完成后,隐私保护数据处理模块按照所选择的匿名化方法及参数对待发布数据进行隐私保护处理,形成可发布数据。

表 1为按照用户身份和数据用途确定数据安全级别,并对应选择匿名化处理方法。

|

下载CSV 表 1 安全等级及匿名化方法对比 Table 1 Comparison of security level and anonymization methods |

由于模型中采用的3种隐私保护方法均为经典的方法,因此本文不再阐述。但是如何选取恰当的参数,目前尚无具体的解决方案,因此,本文研究的重点和阐述的内容主要放在参数的优选上。

3 匿名化方法的参数优选 3.1 k-anonymity方法的k参数优选在k-anonymity隐私保护方法中,k的取值直接影响隐私保护的程度和数据的质量[20-21]。k的取值越大,对应的等价类规模就越大,为了满足k-匿名约束,需要泛化的属性值也越多(泛化范围越大),因此数据质量就越差。但同时由于每个等价类对应的实体也越多,因此猜测每个实体敏感信息的概率也就越小,隐私保护的程度也越高。k的取值越小,对应的等价类规模就越小,为了满足k-匿名约束,需要泛化的属性值就越少(泛化范围越小),因此数据质量就越好。每个等价类对应的实体越少,猜测每个实体敏感信息的概率就越大,隐私保护的程度也越低。因此,k值的选取非常重要,需要从隐私保护程度和数据可用性两个方面考虑。如果选取不当,则会影响隐私保护效果。

因此,首先必须确定隐私保护程度的评价方法和约束条件[22-23]。对于隐私保护程度的评价,用等价类中敏感属性值的最大重复次数与等价类元组数之比来计算,所代表的意义是从任意等价类中推测出某一实体隐私信息的概率。隐私约束条件即为隐私泄露概率阈值,用Pmax来表示,Pmax由数据提供方根据实际数据的情况给出。Pmax与k值的数学关系如下:

| $ ⌊{K}_{\mathrm{m}\mathrm{i}\mathrm{n}}⌋=\frac{1}{1-(1-{P}_{\mathrm{m}\mathrm{a}\mathrm{x}}{)}^{t/{P}_{\mathrm{m}\mathrm{a}\mathrm{x}}}} $ | (1) |

其中,t为等价类中敏感属性值的最大重复次数,

对于数据可用性的评价,文献[12]采用辨识度度量标准(CDM)作为数据质量的评估指标。为更加准确地描述k值与数据质量之间的关系,本文对辨识度度量标准进行了改进,计算方法如下:

| $ {C}_{\mathrm{D}\mathrm{M}}=\sqrt{\frac{\sum\limits_{i=1}^{N}{\left|Q\right|}^{2}}{N}} $ | (2) |

其中,Q表示数据表中第i个等价类的规模,N为等价类数目。CDM值越小,说明数据表中的等价类规模越均匀,数据质量也越好;CDM值越大,说明数据表中的等价类规模相差越大,数据质量也越差。数据质量约束条件即为数据质量阈值,由用户根据数据的特定应用来确定。k值与CDM的数学关系如下:

| $ ⌈{K}_{\mathrm{m}\mathrm{a}\mathrm{x}}⌉=\frac{\left|{C}_{\mathrm{D}\mathrm{M}}\right|+1}{2} $ | (3) |

根据式(1)和式(3),即可求出Kmin和Kmax。由此可以确定,k值的可选范围为[Kmin,Kmax]。k值的选取范围是一个区间值,通常比较宽泛。当k取Kmin时,数据表的数据质量最好,但隐私保护程度最低;当k取Kmax时,数据质量最差,但隐私保护程度最高。因此,k的取值具体需要根据需求来确定。在一般情况下,可以选取两者的中间值,即

由此可见,本文方法在进行k参数优选时,通过确定k的最大和最小取值范围[Kmin,Kmax],可有效地避免k值选取的盲目性,帮助尽快找到最合适的k值,从而为k-anonymity隐私保护方法的应用提供指导和帮助,提高k-anonymity隐私保护方法的有效性和可用性。

3.2 l-diversity方法的l参数优选信息熵在一定程度上反映了属性的分布情况。信息熵越大,意味着等价类中敏感属性值的分布越均匀,推导出具体个体的难度也就越大。为此,文献[9]给出了基于信息熵确定l值的方法,但该方法并没有考虑到数据质量的问题。由于l-diversity方法建立在k-anonymity方法的基础上,因此本文在k值选取方法的基础上,给出了同时满足给定隐私保护要求和数据质量要求的l值取值算法。

算法1 l值取值算法

输入 满足k-anonymity约束的数据表,满足用户给出隐私保护要求与数据可用性要求的k值

输出 l值

1)计算由信息熵模型确定的l值。

假设:A为准标识属性,SA为敏感属性,S={Si…Sj}为敏感属性值,等价类集合为E={Ei…Ej},则l的计算公式为:

| $ {\sum }_{S}^{E}p(E, S)\mathrm{l}{\mathrm{g}}_{}p(E, S)\ge \mathrm{l}\mathrm{g}l $ | (4) |

其中,p、E、s为等价类Ei中敏感属性值s出现的频率,

2)l值从最小值开始取值。判断数据表是否满足l-diversity约束,若满足,则参数调整结束。l值即为该步骤下取得的l值。

3)若不满足约束,则添加和该等价类内准标识属性值相同的元组。添加元组的敏感属性值类别为表中包含的,且在该等价类中并不包含的类别,直至数据表满足l-diversity约束。

4)重新计算数据表的CDM值,判断该值是否小于满足l-diversity最小值约束的数据表的CDM值。若小于该值,则说明经过l-diversity处理后,数据表的数据可用性满足用户要求,那么参数调整结束。

5)若不满足,则l值加1,返回步骤2),直至l值增加到最大值。

6)若l值尝试到最大值时,仍不满足条件,此时k值加1,返回步骤1)。

7)若k值增至最大值时,所有l值仍不满足,则参数选取失败。

该取值算法最终取得的(k,l)参数,即为同时满足给定的隐私保护要求和数据质量要求的参数。

从实现成本上来看,为了平衡隐私保护要求和数据质量要求,需要增加一个(k,l)参数选取算法,较k参数的优选成本有较大提升。

该算法的算法复杂度仅为O(k×l)。复杂度与k值和l值成正比,随着k和l的增大而增大。因此,尽快确定k和l参数,能够有效降低算法的复杂度。

若(k,l)参数选取失败,则表明隐私保护要求和数据质量要求相冲突,算法不能同时满足给定的隐私保护要求和数据质量要求。此时,已不再适合采用l-diversity方法,应选择k-anonymity方法进行隐私保护,除非提高隐私泄露阈值或降低数据质量要求。

3.3 t-closeness方法的t参数优选在t-closeness方法中,给定不同的t参数将直接影响要保护数据表的隐私保护程度和数据质量。一般来说,t值越大,分布差异也越大。那么,对数据的约束就越宽松,相应的数据质量就越好,相对应地,隐私保护的程度就越低。反之,t值越小,等价类的分布就需要更加接近被保护数据表的分布。那么,为满足t-closeness的隐私约束,需要泛化的属性就越多(泛化范围越大),数据质量就越差,但同时每个等价类对应的实体也越多,因此猜测每个实体敏感信息的概率就越小,隐私保护程度也越高。

综上可以看出,t值的选取非常重要,需要从隐私保护程度和数据可用性两个方面考虑。选取不当,就会影响隐私保护效果。为此,本文提出一个t值选取方法,可以选取同时满足隐私保护要求和数据可用性要求的t值。

t参数选取算法的主要思想就是通过迭代的方式不断地调整t值,使得CDM小于由Pmax决定的CDM的初始值(即满足隐私保护要求的数据表所能到达的最佳数据质量),记为

| $ {C}_{\mathrm{D}\mathrm{M}}^{1}=\frac{2}{1-(1-{P}_{\mathrm{m}\mathrm{a}\mathrm{x}}{)}^{t/{P}_{\mathrm{m}\mathrm{a}\mathrm{x}}}}-1 $ | (5) |

当CDM小于该值时,数据表的数据可用性必定满足用户对于数据质量的要求,那么此时对应的t值就是最优的。

算法2 t参数选取的算法

输入 经过泛化的表T、Pmax

输出 t

1)数据表T的等价类集合为E={Ei…Ej},P为Di所有值的集合。

2)令

| $ {C}_{\mathrm{D}\mathrm{M}}^{1}=\frac{2}{1-(1-{P}_{\mathrm{m}\mathrm{a}\mathrm{x}}{)}^{t/{P}_{\mathrm{m}\mathrm{a}\mathrm{x}}}}-1 $ |

其中,Di表示第i个等价类中敏感属性值的分布与全局分布的距离。

3)令表T满足t值为Dmin的t-closeness约束,计算表T的CDM值。若小于

4)若不满足,则t值增加Dmin,返回步骤3,直到

5)若

通过该参数选取算法所取得的参数,即为同时满足给定的隐私保护要求和数据质量要求的参数。如果参数选取失败,说明隐私保护要求和数据质量要求相冲突,不能同时满足给定的隐私保护要求和数据质量要求。此时,已不再适合采用t-closeness方法,除非提高隐私泄露阈值或降低数据质量要求。

由于t的取值范围为(0~1),因此在进行t值选取的过程中,为降低算法的复杂性,提高收敛速度,本算法将t值控制在两位精度。

4 实验本文实验所采用的数据集为医院患者数据集,包含25 000条记录,大小为2.3M。其中包含患者的基本信息和疾病信息,共计5个属性,准标识属性共4个,分别为{性别,年龄,出生日期,邮编},敏感属性共1个,为{疾病}。在数据的预处理过程中,将数据的显标识属性和含有缺失值的元组去除。

下文主要从方法的扩展性、数据的可用性和隐私保护的效果3个方面对模型的性能进行评价。

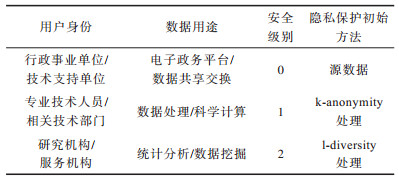

4.1 算法扩展性实验设初始值k=5,l=4,t=0.25,测试在不同数据量情况下,采用k-anonymity、l-diversity和t-closeness 3种匿名隐私保护方法进行匿名化处理的执行时间随数据量变化而变化的情况,如图 2所示。

|

Download:

|

| 图 2 不同方法的实验结果 Fig. 2 Experimental results of different methods | |

在给定其他参数值时,图 2中曲线的变化趋势是一致的。从图 2可以看出,当利用3种匿名化方法处理同样的数据量时,k-anonymity耗时最少,l-diversity次之,t-closeness耗时最多。这是因为3种方法的隐私保护程度是递增的,因而方法的复杂性也是递增的。但是,3种方法的执行时间都随着数据量的增加基本呈线性增长,这说明3种方法的可扩展性较好。

4.2 数据可用性实验为测试通过参数选取方法所取得的参数是否能够满足数据可用性要求,并且同时满足隐私保护要求,提取实验数据集中的3 000条记录,属性集与上文实验所用的数据集相同,假设隐私泄露概率阈值Pmax=0.25。根据上面的参数选取方法所计算出来的参数分别为k=7、l=5、t=0.42。

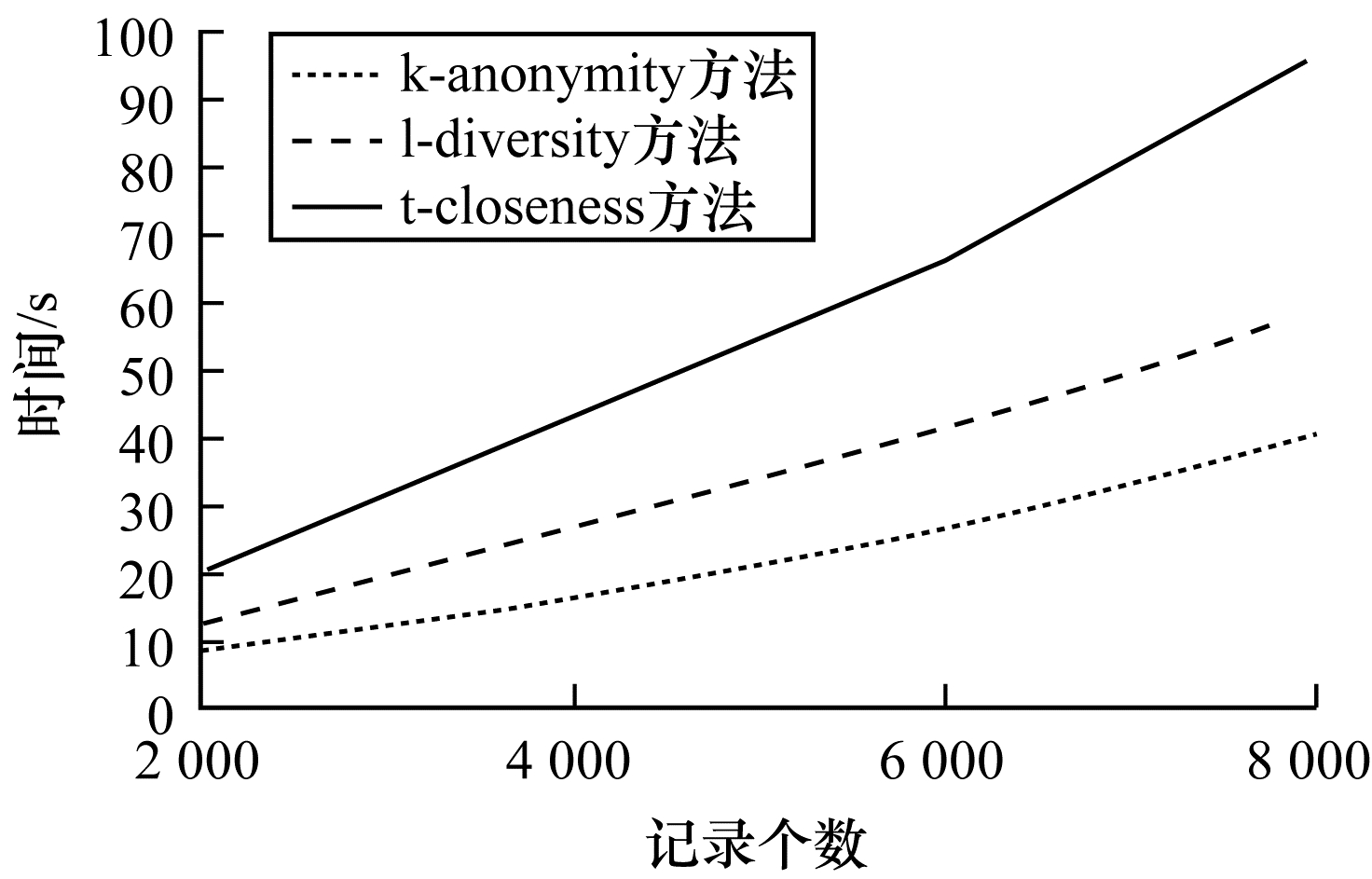

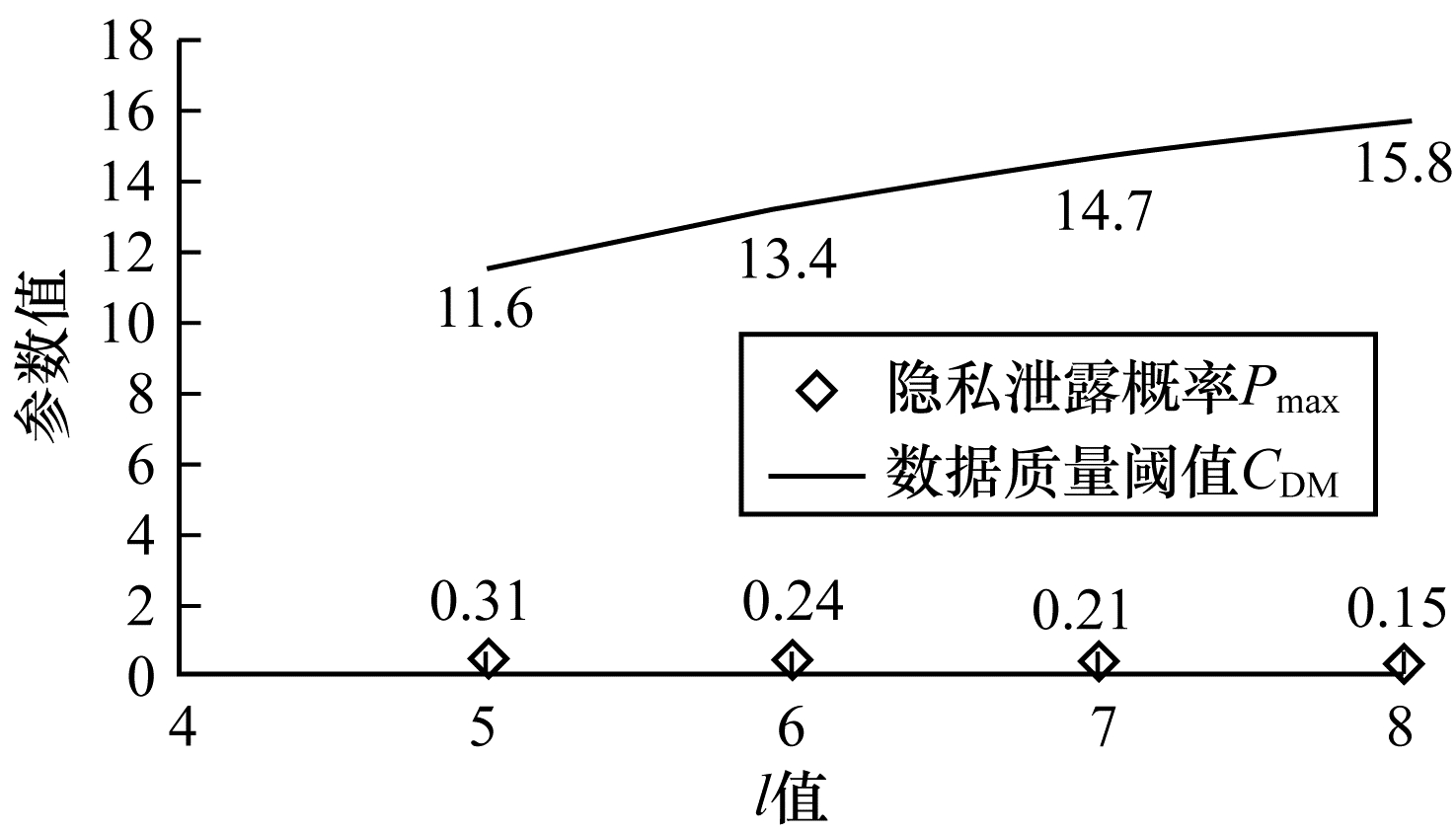

不同k值对应的数据质量指标CDM与隐私泄露概率阈值Pmax的对应关系如图 3所示。

|

Download:

|

| 图 3 不同k值对应的数据可用性实验结果 Fig. 3 Experimental results of data availability corresponding to different k values | |

从图 3可以看出,数据质量随着隐私泄露概率阈值的降低而提高。只要k≥7与Pmax≤0.25,均满足隐私保护要求,但当k=7、Pmax =0.23时,CDM值是满足隐私保护要求的参数值中最小的,对应的数据质量最优。由此表明,通过k值选取算法可以得到数据质量最优,且满足隐私保护要求的参数。

l值选取算法的实验结果如图 4所示。

|

Download:

|

| 图 4 不同l值对应的数据可用性实验结果 Fig. 4 Experimental results of data availability corresponding to different l values | |

从图 4可以看出,由于l-diversity比k-anonymity更严格,因而隐私保护程度更高。对应地,l-diversity的Pmax比k-anonymity的Pmax值应更小。经过l-diversity进行隐私保护处理后的数据质量更差。对应地,l-diversity的CDM比k-anonymity的CDM值也更大。为此,在给定Pmax=0.25的情况下,就要向下寻找满足Pmax≤0.25情况下可以取得的l值。l的可取值范围为5、6、7。显然,取l=5可取得最小的CDM,即在满足隐私保护要求的前提下,当l=5时数据质量最优。由此说明,本文提出的l值选取算法可以得到数据质量最优,且满足隐私保护要求的参数。

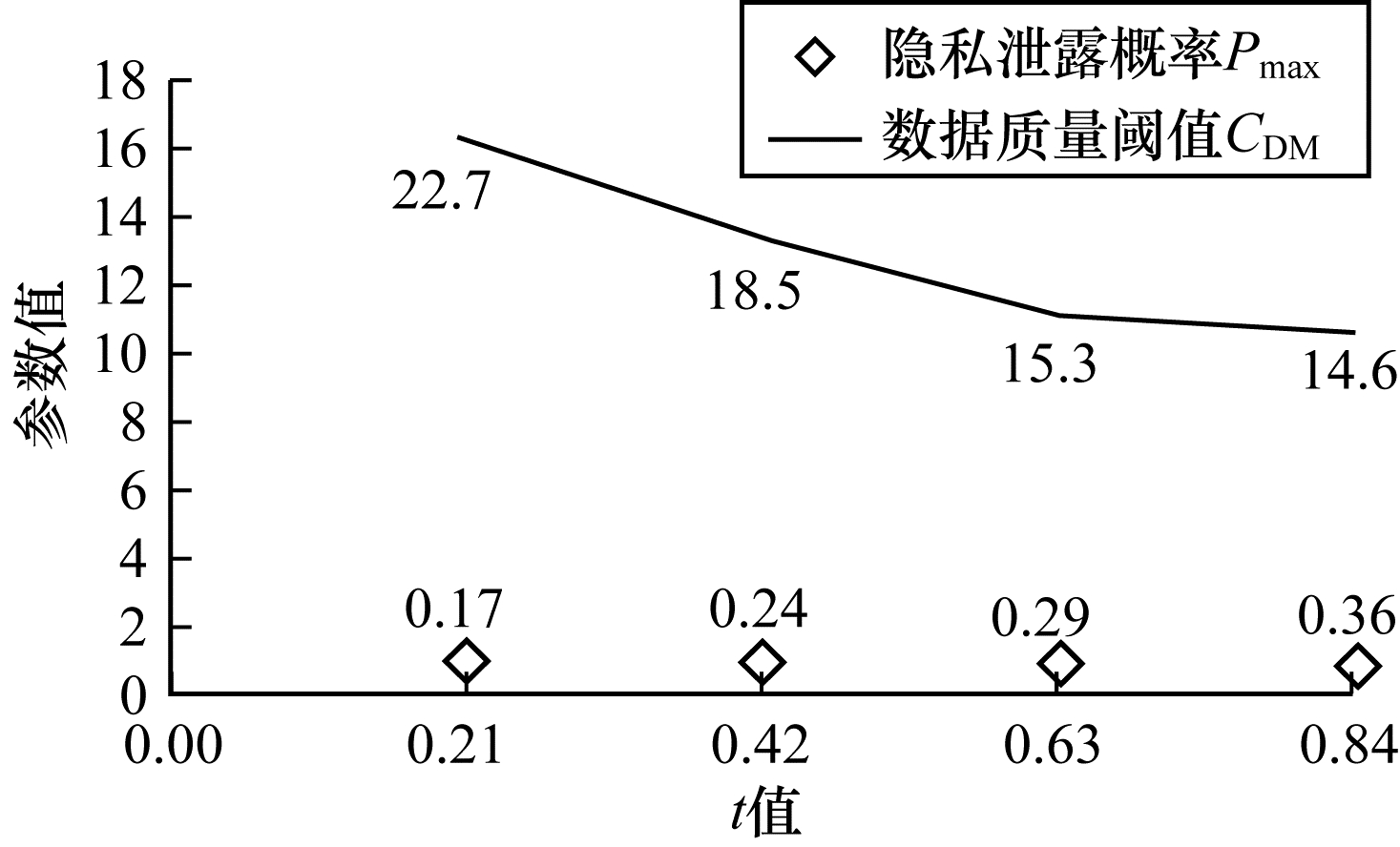

t值选取算法的实验结果如图 5所示。

|

Download:

|

| 图 5 不同t值对应的数据可用性实验结果 Fig. 5 Experimental results of data availability corresponding to different t values | |

从图 5可以看出,t值的间隔为0.21,该值为最小规模等价类的EMD距离。t值越大,即分布差异越大,对隐私的约束就越宽松。对应地,隐私保护程度就会相应降低,数据质量也就会越好。因此,在满足隐私保护要求的所有t值(t=0.42,t=0.21)中,取t=0.42比t=0.21的数据质量更优。由此证明,t值选取算法可以得到数据质量最优,且满足隐私保护要求的参数。

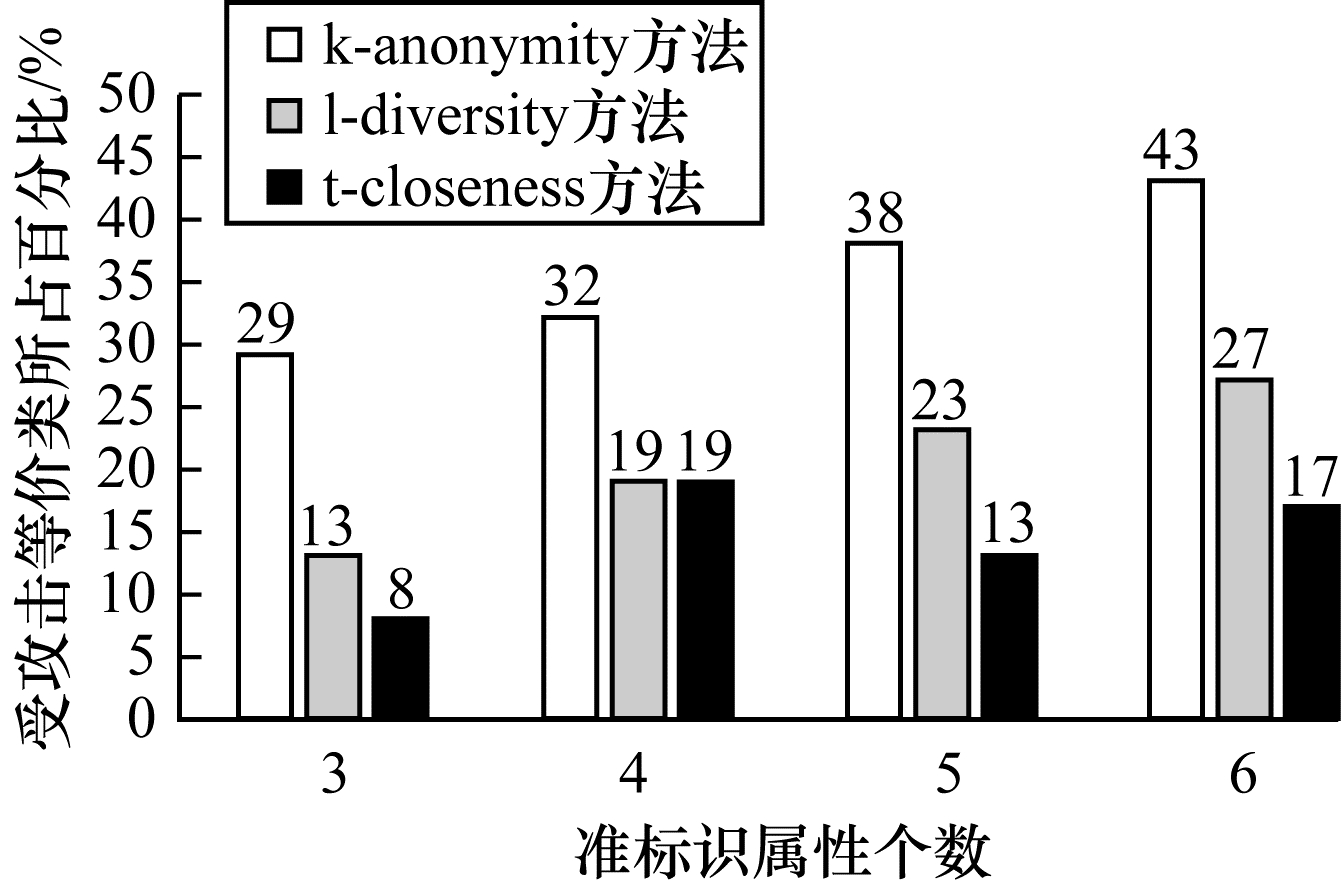

4.3 隐私保护效果实验本文实验主要验证在不同属性集的情况下,经过匿名化处理后数据集抵御攻击的能力。对此可通过计算不能抵御攻击的等价类占所有等价类的比例进行判断。实验结果如图 6所示。

|

Download:

|

| 图 6 不同匿名方法的抵御攻击比较 Fig. 6 Comparison of anti-attack capabilities of different anonymous methods | |

从图 6可以看出,随着准标识属性的增加,等价类生成的规模也越来越小,越来越难以满足匿名约束,由此导致3种方法整体的抵御攻击能力逐渐变弱。从3种方法的比较可以看出,k-anonymity的抵御攻击能力最差,这是因为k-anonymity没有对敏感属性值做任何约束。而l-diversity和t-closeness针对这一问题进行了改进,所以抵御攻击的能力递进增强。

由于l-diversity要求每个等价类中至少含有l个敏感属性值,因此需要对k-anonymity处理后的数据进行l-diversity约束判断。尽管l-diversity相比于k-anonymity做了很大的改进,但是仍然无法避免相似性攻击。所谓相似攻击是指在某一敏感属性值占比过大的情况下,攻击者有较高概率可以推断出个体隐私。由于t-closeness方法进一步考虑了敏感属性值的分布问题,因此要求任何一组等价类中的敏感值分布与该属性在整个数据表中的分布差异不能超过预先设定的阈值t,从而解决了相似性攻击的问题。

5 结束语在保证数据可用性的同时又不泄露个体隐私是大数据发布的基本要求和前提。本文设计基于匿名化隐私保护方法的大数据发布系统模型。根据用户的不同身份和数据的不同应用需求,选择合适的匿名化方法和参数,有效地实现隐私保护,并提出了针对模型中3种方法的参数优选方法,使得经过处理后的数据既可以达到数据提供方所要求的隐私保护效果,同时也能够满足数据使用方对数据可用性的要求。实验结果证明了该方法的有效性。由于本文只研究了关系型数据的静态发布问题,下一步将研究有关数据增量更新和动态发布的问题。

| [1] |

OH S, PARK S. Task-role based access control model[J]. Information Systems, 2014, 28(6): 533-562. |

| [2] |

LONG Qin, LIU Peng, PAN Aimin. Research and implementation of an extended administrative role-based access control model[J]. Journal of Computer Research and Development, 2005, 42(5): 868-876. (in Chinese) 龙勤, 刘鹏, 潘爱民. 基于角色的扩展可管理访问控制模型研究与实现[J]. 计算机研究与发展, 2005, 42(5): 868-876. |

| [3] |

AGRAWAL C C, YU P S. Privacy-preserving data mining: models and algorithms[M]. [S. 1. ]: Springer, 2008.

|

| [4] |

FUNG B C M. Privacy-preserving data publishing[D]. Vancouver, Canada: Simon Fraser University, 2007.

|

| [5] |

FUNG B C M, WANG K, CHEN R, et al. Privacy-preserving data publishing: a survey on recent developments[J]. ACM Computing Surveys, 2010, 42(4): 14-53. |

| [6] |

TORE D, REISS S P. Data-swapping: a technique for disclosure control(extended abstract)[C]//Proceedings of Section on Survey Research Methods American Statistical Association. Washington D.C., USA: IEEE Press, 1998: 191-194.

|

| [7] |

EVMIFIEVSKI A. Randomization in privacy preserving data mining[J]. ACM SIGKDD Explorations News Letter, 2002, 4(2): 43-48. DOI:10.1145/772862.772869 |

| [8] |

OLIVEIRA S R M, ZAIANE O R. Privacy preservation clustering by data transformation[C]//Proceedings of the 18th Brazilian Symposium on Databases. Washington D.C., USA: IEEE Press, 2003: 304-318.

|

| [9] |

OLIVEIRA S R M, ZAIANE O R. Privacy preservation when sharing data for clustering[C]//Proceedings of International Workshop on Secure Data Management in a Connected World. Washington D.C., USA: IEEE Press, 2004: 67-82.

|

| [10] |

SAMARATI P, SWEENEY L. Protecting privacy when disclosing information: k-anonymity and its enforcement through generalization and suppresion[C]//Proceedingsof IEEE Symposium on Research in Security and Privacy. Washington D.C., USA: IEEE Press, 1998: 384-393.

|

| [11] |

MACHANAVAJJHALA A, GEHRKE J, KIFER D. l-diversity: privacy beyond k-anonymity[C]//Proceedings of the 22nd International Conference on Data Engineering. Atlanta, USA: IEEE Press, 2006: 24-36.

|

| [12] |

LI Ninghui, LI Tiancheng, VENKATASUBRAMANIAN S. T-closeness: privacy k-anonymity and 1-diversity[C]//Proceedings of the 23rd ICDE'07. Washington D.C., USA: IEEE Press, 2007: 106-115.

|

| [13] |

BYUN J W, SOHNY Y, BERTION E, et al. Secure anonymization for incremental datasets[C]//Proceedings of the 3rd VLDB Workshop on Secure Data Management. Berlin, Germany: Springer, 2006: 48-63.

|

| [14] |

YANG Xiaochun, WANG Yazhe, WANG Bin, et al. Privacy preserving approaches for multiple sensitive attributes in data publishing[J]. Chinese Journal of Computers, 2008, 31(4): 574-587. (in Chinese) 杨晓春, 王雅哲, 王斌, 等. 数据发布中面向多敏感属性的隐私保护方法[J]. 计算机学报, 2008, 31(4): 574-587. DOI:10.3321/j.issn:0254-4164.2008.04.004 |

| [15] |

LI Yanjun. Research on privacy preserving methods for multiple sensitive attributes based on attributes classification[D]. Chongqing: Chongqing University, 2013. (in Chinese) 李艳军. 基于属性分类的多敏感属性数据隐私保护方法研究[D]. 重庆: 重庆大学, 2013. |

| [16] |

SAMARATI P, SWEENEY L. Generalizing data to provide anonymity when disclosing information(abstract)[C]//Proceedings of the 17th ACM-SIGMOD-SIGACT-SIGART Symposium on the Principles of Database Systems. New York, USA: ACM Press, 1998: 188-199.

|

| [17] |

QU Shiyan, JIANG Xinghao, SUN Tanfeng, et al. Purpose management-based privacy access control model for his[J]. Computer Applications and Software, 2011, 28(3): 74-76. (in Chinese) 渠世艳, 蒋兴浩, 孙锬锋, 等. 基于目的管理的医疗信息系统隐私保护访问控制模型[J]. 计算机应用与软件, 2011, 28(3): 74-76. DOI:10.3969/j.issn.1000-386X.2011.03.021 |

| [18] |

ZHANG Yiyuan. Analysis of assessment methods based on privacy preserving for data mining[D]. Changchun: Jilin University, 2012. (in Chinese) 张苡源. 应用面向数据挖掘的基于隐私保护的评估方法的分析[D]. 长春: 吉林大学, 2012. |

| [19] |

XU Xinhui. Anonymization of set-valued data for privacy preserving data publishing[D]. Shanghai: Shanghai Jiao Tong University, 2013. (in Chinese) 许信辉. 隐私数据发布下的集合型数据匿名化保护方法[D]. 上海: 上海交通大学, 2013. |

| [20] |

TONG Yunhai, TAO Youdong, TANG Shiwei, et al. Identity-reserved anonymity in privacy preserving data publishing[J]. Journal of Software, 2010, 21(4): 771-781. (in Chinese) 童云海, 陶有东, 唐世渭, 等. 隐私保护数据发布中身份保持的匿名方法[J]. 软件学报, 2010, 21(4): 771-781. |

| [21] |

JIANG Baoyan. The design and implementation of the k-anonymity algorithm based on multi-attribute generalization[D]. Dalian: Dalian University of Technology, 2015. (in Chinese) 姜宝彦. 基于多属性泛化的k-匿名算法的设计与实现[D]. 大连: 大连理工大学, 2015. |

| [22] |

HAO Zhifeng, WANG Riyu, CAI Ruichu, et al. Privacy data publishing method based on bayesian network and semantic tree[J]. Computer Engineering, 2019, 45(4): 124-129. (in Chinese) 郝志峰, 王日宇, 蔡瑞初, 等. 基于贝叶斯网络与语义树的隐私数据发布方法[J]. 计算机工程, 2019, 45(4): 124-129. |

| [23] |

WANG Qun. Research on privacy-preservation anonymity method for data sharing[D]. Harbin: Harbin Engineering University, 2012. (in Chinese) 王群. 面向共享的数据隐私保护匿名方法研究[D]. 哈尔滨: 哈尔滨工程大学, 2012. |

2021, Vol. 47

2021, Vol. 47