开放科学(资源服务)标志码(OSID):

信息网络的迅速发展使得数据规模呈现爆发式增长,各种应用软件(如电子商务平台等)对数据的依赖性越来越强[1]。但是,数据的增量超过了平台或系统的承受范围,这种现象被称为“信息过载”问题[2]。文献[3]提出的Tapestry方法对数据进行筛查过滤,初步缓解了该问题,象征着推荐系统(Recommender System,RS)雏形的形成。1997年,RESNICK等[4]对推荐系统做出了结构化的定义,标志着推荐系统的发展进入萌芽阶段。早期的推荐系统主要应用于信息检索领域,在工业界并没有得到广泛关注。随着信息技术的高速发展,数据的生成速度异常迅猛,推荐系统逐渐在购物、影音等领域得到了广泛的应用。直至今日,推荐系统在学术界和工业界都有着极高的研究价值与应用意义。

推荐系统作为为用户提供建议或推荐商品的软件工具技术,旨在满足用户需求的同时推荐用户感兴趣的物品[4-6],比如“淘宝”的个性化商品推荐、抖音(TikTok)的个性化短视频推荐、“今日头条”的新闻资讯推荐等。根据推荐系统的相关研究,推荐系统的发展可以分为协同过滤算法的提出、推荐算法的商业化应用、推荐算法的深度研究热潮等3个阶段[7],分别象征着推荐系统从萌芽走向成熟的3个历程。其中,推荐系统能够快速发展的优势体现在它提高了用户和系统之间的黏性以及信息利用率,使其具有较高的商用价值。例如,亚马逊(Amazon)将推荐系统应用于商品电子商务系统[8],为其带来了20%~30%的额外营业额。

近年来,应用软件的数量呈现爆发式增长,滋生了越来越多的多源异构数据。这些数据来源多样、结构复杂,传统机器学习方法无法有效地提取其中的表征。面临数据带来的一系列问题,深度学习对多源异构数据表征的充分学习获得了广泛的关注,迅速成为研究热点之一。深度学习作为前沿技术,泛指端到端的非线性可微模型。其优势主要体现在非线性转换、深层特征学习、高弹性及可用性等3个方面。在学术研究层面,深度学习的快速发展激发了学者对推荐领域学术研究的兴趣,逐渐出现了Wide & Deep[9]、CDL[10]、AutoRec[11]等经典的深度推荐模型。在工业应用层面,基于深度学习应用的推荐算法不断改进与创新[12-14],为各领域的产品提供商业化服务。

现有研究大部分集中于协同过滤[2]的相关内容,较少关注于内容推荐的研究。本文研究内容推荐的现状,介绍基于内容的推荐思路,阐述常用的深度学习技术,从技术应用的角度对近年来的深度推荐算法进行综述,分析各模型之间的优缺点,在此基础上给出深度学习在推荐领域的未来研究方向。

1 基于内容的推荐方法2005年,ADOMAVICIUS等[15]提出了推荐系统的形式化定义,将推荐算法分为基于内容的推荐、协同过滤推荐、混合推荐等3类。基于内容的推荐顾名思义是将内容相似的物品进行推荐的一种方法;协同过滤推荐可以分为基于近邻和基于模型的推荐方法,是利用用户物品交互数据(比如评分数据)实现推荐(预测)的推荐方法;混合推荐是通过组合不同的模型弥补模型之间的缺点来提高整个系统推荐性能的一种方法[16]。本节主要从推荐的算法思路、优劣势等角度阐述基于内容的推荐方法。

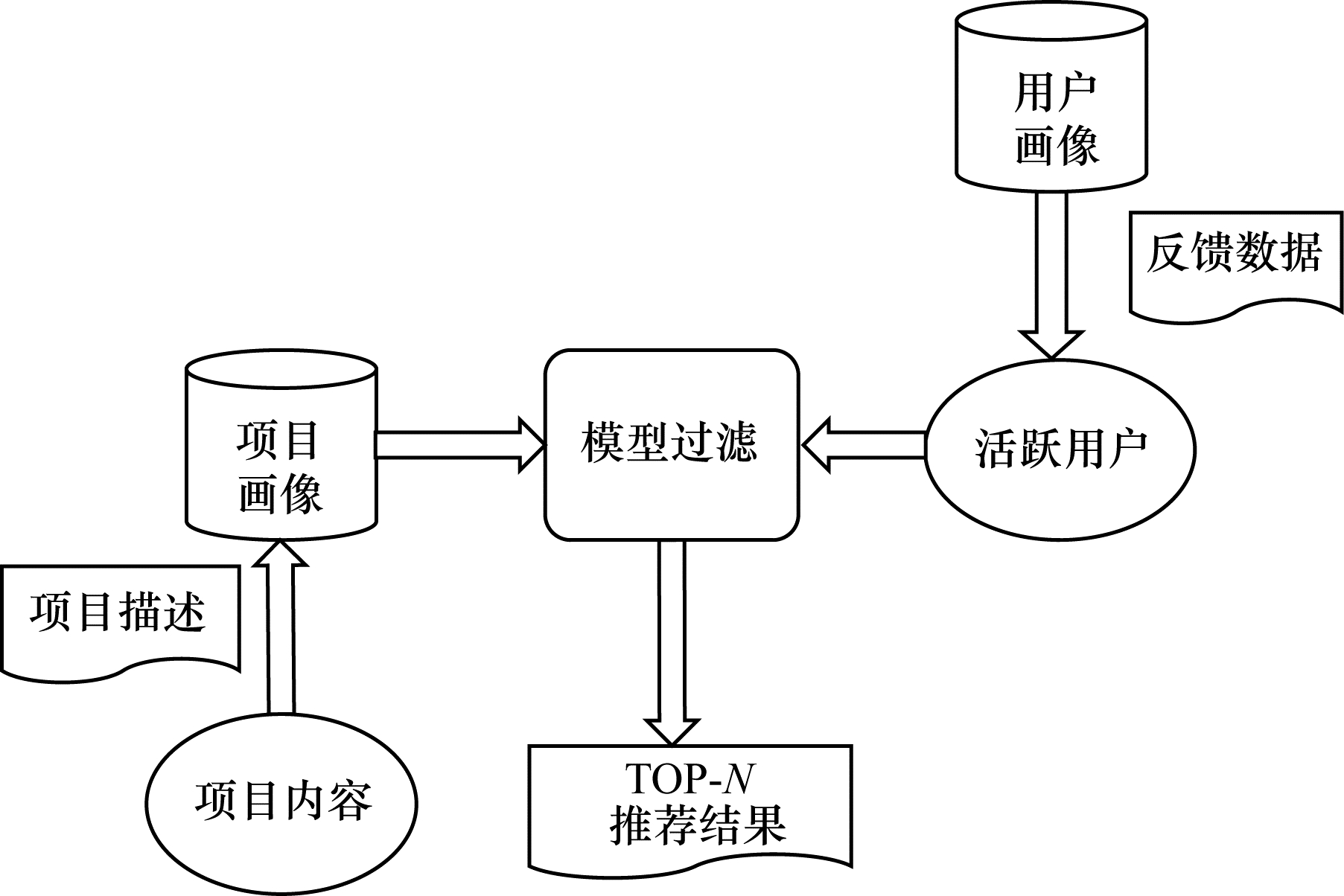

基于内容的推荐方法的提出源于信息检索的研究[17]。由于信息检索的快速发展以及邮件等应用的普遍性,基于内容的推荐方式在信息检索中得到了广泛应用。基于内容的推荐方法主要包含物品的内容特征描述与用户画像(兴趣爱好)2类数据。在传统信息检索领域中,如何有效地构建用户画像是推荐方法快速发展的关键要素[18]。在此背景下,推荐系统可定义为从数据库中寻找与用户画像相似度最高的物品推荐给用户的一个应用技术。例如在音乐推荐中,每一首歌都存在多种标签信息,相似的音乐会存在很多一样的标签信息,系统分析用户的历史听歌记录,可以得到一个基于音乐的用户画像,从而从音乐库中寻找符合用户画像的相似音乐推荐给目标用户。

基于内容的推荐方法的具体实现步骤如下:

步骤 1 构建用户物品画像。物品画像是物品的一系列内容特征的结构化表示r(i),例如电影的分类信息包含标题、主题曲、主演、导演等信息;而用户画像是根据已知用户的历史兴趣得到的用户特征结构化表示r(u),比如行为偏好、喜欢的物品类型、活跃程度等信息[19]。

步骤 2 根据用户画像从数据库中寻找用户偏好的前N个相似(TOP-N)物品item进行推荐。形式化表达公式如下:

| $ \text{item}=\text{argmax}\left\{ \text{sim}\left( {{r}^{\left( u \right)}}\times {{r}^{\left( i\text{ }\!\!~\!\!\text{ } \right)}} \right) \right\}\text{ }\!\!~\!\!\text{ } $ | (1) |

其中:

|

Download:

|

| 图 1 基于内容的推荐框架 Fig. 1 Content-based recommendation framework | |

基于内容的推荐方法可以高效地筛选更有价值的信息,其主要优点有:1)推荐效率高;2)推荐结果精准直观;3)不需要用户的评价等其他信息;4)不存在数据稀疏性问题;5)没有物品冷启动问题。随着物品数量增加、用户偏好和数据来源复杂化,基于内容的推荐方法也出现了很多难以解决的问题,主要包含物品特征多且难以提取、推荐内容太过单一、新用户冷启动等问题。

此外,协同过滤算法以及混合推荐方法在推荐领域同样具有非常高的研究价值,近年来诞生了较多的优秀研究成果[20-22],本文不再展开论述。

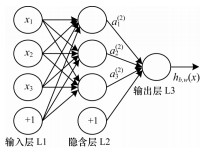

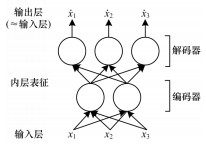

2 深度学习技术深度学习作为机器学习的子领域,旨在学习数据中的深层特征,即从数据中学习多层次的表征和抽象。从深度学习的定义角度出发,如果一个神经可微的端到端架构使用随机梯度下降(Stochastic Gradient Descent,SGD)法来优化可微目标函数,那么这种结构可以称为深度学习。近年来,深度学习在有监督和无监督的学习任务中都有着较好的性能提升[23],在表征学习中得到了广泛的应用。本节主要描述常用的深度学习技术以及深度学习应用的优势。

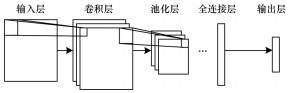

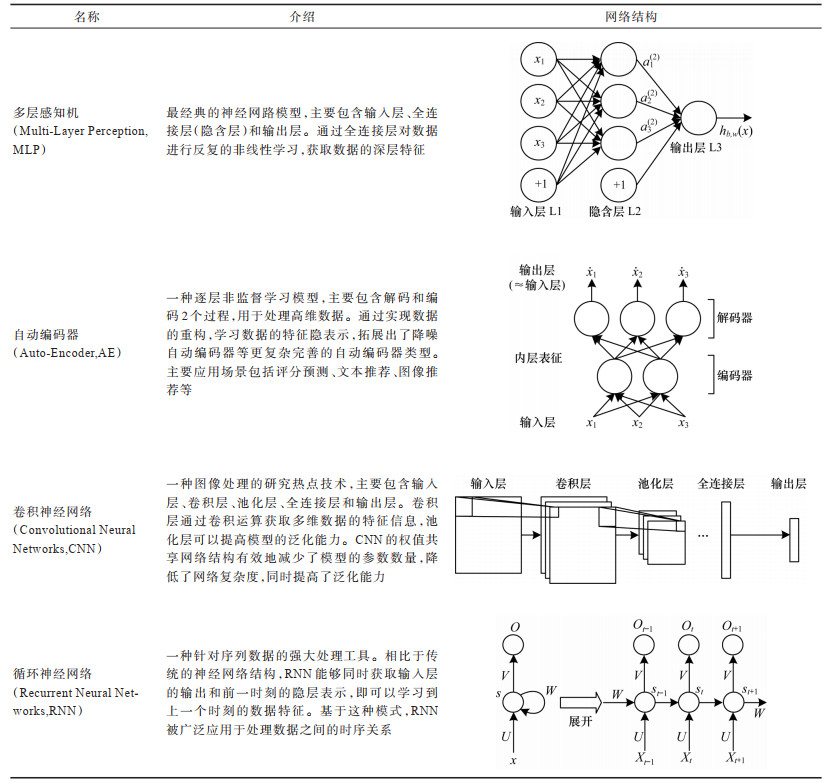

2.1 常用深度学习技术随着深度学习研究的深入,涌现出从简单到复杂的多类型深度学习技术[24]。本节主要介绍在推荐领域中常用的4类深度学习技术,如表 1所示。

|

下载CSV 表 1 典型深度学习技术介绍 Table 1 Introduction of typical deep learning techniques |

传统推荐方法已经在电子商务、影音推荐等多领域中得到了广泛的应用,但是基于浅层模型的内容推荐以及协同过滤算法仍然存在数据稀疏性[25-26]、冷启动[27]等常见问题。在数据学习方面,浅层模型的学习能力远不及深度学习强大。深度学习技术运用其复杂的非线性结构在推荐等多领域中学习数据的深层表征,提升了推荐性能。比如在处理文本数据[28-29]、图像数据等多源异构数据时,卷积神经网络(CNN)以及循环神经网络(RNN)成为了必不可少的利器。HE等[30]利用多层感知机(MLP)学习特征交互,相比于矩阵分解(Matrix Factorization,MF)有更好的性能提升。在当前的研究环境中,深度学习的发展已经与推荐系统紧密相关。

综上,本节介绍了深度学习在推荐领域的算法优势:

1)非线性转换。相比于传统线性模型,深度学习技术拥有强大的非线性转换能力,比如深度网络中常用的激活函数relu、sigmoid、tanh等。这种非线性转换能力有利于模型学习到用户和物品更加复杂的特征关联信息[31-32]。

2)深层特征学习。深度神经网络能够有效地学习到输入数据的深层特征。在现实世界中,每个用户或物品都是一个包含多种信息的数据体。利用这些信息可以帮助系统更好地学习用户或物品,从而提供更好的推荐结果。使用深度神经网络学习模型的优势具体体现在以下2个方面:(1)由于实现了自动特征处理,因此免去了传统的人工特征处理所需要花费的精力和人力;(2)这种网络结构可以帮助推荐系统学习多源异构数据,比如图像、音频、视频等数据。

3)高弹性及可用性。随着对深度学习的深入研究,越来越多的深度学习开源平台被提出,如Tensorflow、PyTorch等。依赖深度学习开源平台的支持,深度学习模型的应用有了更多的拓展性和实现空间。深度学习技术的模块化也使得模型实现变得更加灵活。

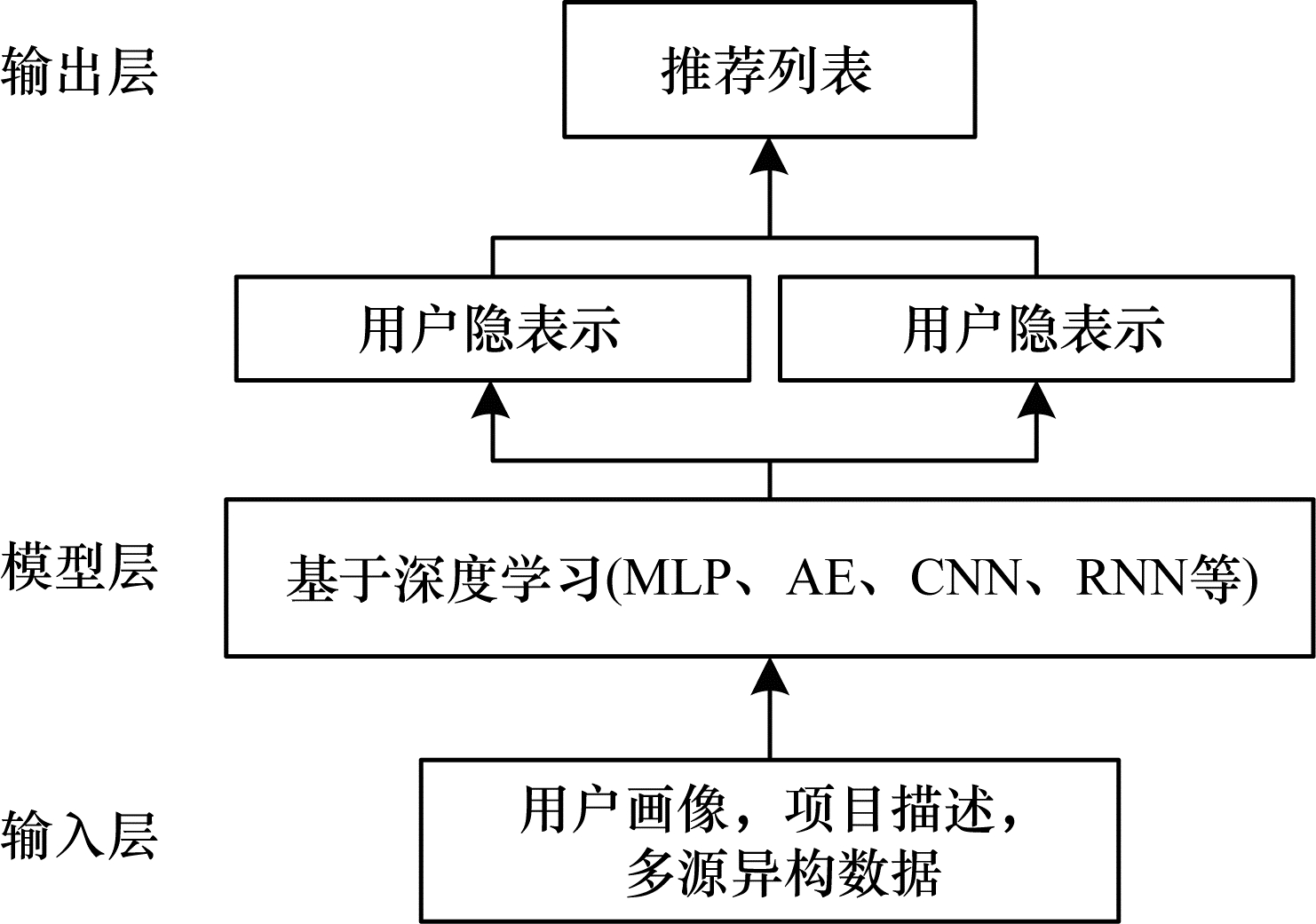

3 基于深度学习的内容推荐方法本节从深度学习技术的应用展开阐述,介绍深度学习下的推荐算法研究成果。随着应用软件的激增,数据呈现多源异构,传统机器学习的表征学习性能不佳,深度学习逐步代替传统机器学习实现深层表征学习。在推荐领域中,除了将深度学习模型直接应用于推荐系统外,传统的推荐算法(如矩阵分解、因子分解机)结合深度学习算法,也可以表示为神经可微的端到端架构[30, 37],并在Tensorflow、PyTorch等深度学习开源平台中有效地进行训练。本节是本文的核心,主要探究并梳理基于内容的深度学习推荐方法。在特征学习中,基于内容的推荐方法主要依赖于文本、评论等内容数据,需要对内容进行琐碎的预处理(关键词提取、主题建模等);而在深度学习中可以直接通过端到端的结构学习所有内容特征。

基于深度学习的内容推荐框架如图 2所示。

|

Download:

|

| 图 2 基于深度学习的内容推荐框架 Fig. 2 Deep learning based content recommendation framework | |

多层感知机(MLP)作为一种简明有效的网络,能够有效地优化目标函数,提高模型准确率[32],在推荐系统等多领域中得到了广泛的应用。

Wide & Deep模型[9]是Google公司为了实现应用软件推荐提出的一种经典模型。该模型可以分成Wide模型和Deep模型2个部分:

1)Wide模型是一个简单的单层线性模型,直接学习数据的交叉特征,主要实现模型的记忆能力。该层模型的学习公式如式(2)所示:

| $ y = \mathit{\boldsymbol{W}}_{{\rm{wide}}}^{\rm{T}}\left\{ {x, \phi \left( x \right)} \right\} + b $ | (2) |

其中:

2)Deep模型是一个多层神经网络(MLP),将稀疏数据转换为稠密向量,输入网络中学习特征的深层表示,主要实现模型的泛化能力。每一层的激活公式如式(3)所示:

| $ {a^{\left( {l + 1} \right)}} = f\left( {\mathit{\boldsymbol{W}}_{{\rm{deep}}}^{\left( l \right)}{a^{\left( l \right)}} + {b^{\left( l \right)}}} \right) $ | (3) |

其中:l表示第l层;f(·)表示激活函数;

由于2个模型的完全独立性,因此可以通过并行操作提高模型的训练效率。Wide & Deep模型的预测公式如式(4)所示:

| $ P\left( {{{\hat r}_{ui}} = 1|x} \right) = \sigma \left( {\mathit{\boldsymbol{W}}_{{\rm{wide}}}^{\rm{T}}\left\{ {x, \phi \left( x \right)} \right\} + \mathit{\boldsymbol{W}}_{{\rm{deep}}}^{\rm{T}}{a^{\left( {{l_f}} \right)}} + {\rm{bias}}} \right) $ | (4) |

其中:

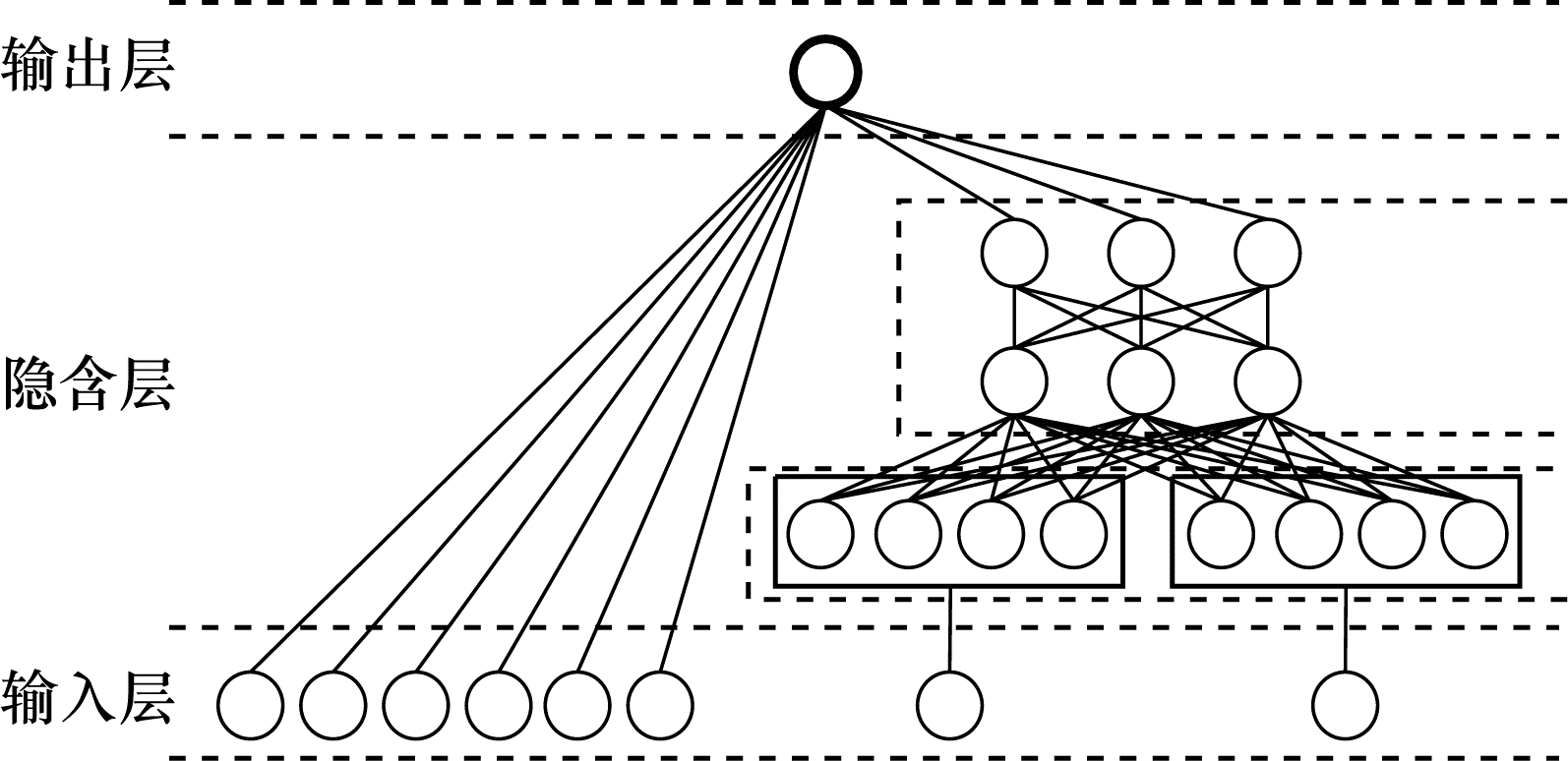

图 3所示为该模型的网络结构。后续提到的DeepFM[38]模型,就是将Wide模型替换为FM模型实现的。

|

Download:

|

| 图 3 Wide & Deep模型结构 Fig. 3 Wide & Deep model structure | |

Wide & Deep模型虽然具有一个优秀的双塔式学习结构,但是需要复杂的人工特征工程,且在现实场景中存在学习效率低等问题。因此,CHEN等[39]基于Wide & Deep模型提出了针对工业级数据的局部连接Wide & Deep模型。在该模型中,CHEN等应用高效的局部连接神经网络替换全连接神经网络来提高模型学习效率。为了进一步提高推荐性能,ALASHKAR等[40]提出了基于MLP的推荐模型。该模型构建了2个相同的神经网络分别训练样本集和专业知识库。实验结果表明,专业知识可以更有效地引导推荐,提高推荐效率和准确率,但是专业知识的获取高度依赖于人工干涉。在千万量级乃至更多的数据中直接进行推荐,效率低而且准确率不高,常常需要两阶段实现推荐过程。COVINGTON等[12]将MLP应用于实现YouTube的推荐,主要将系统划分成候选集生成和候选集排序。候选集生成主要将所有的电影数据进行筛选,获得一个成百上千量级的候选集(子集)。候选集排序则是基于候选集数据,利用神经网络转换的用户物品特征向量进行最近邻相似度计算得到TOP-N的推荐结果。相比于候选集生成,候选集排序利用了更多的特征信息,在前者的基础上结合神经网络、逻辑回归等技术预测更加准确的电影评分。

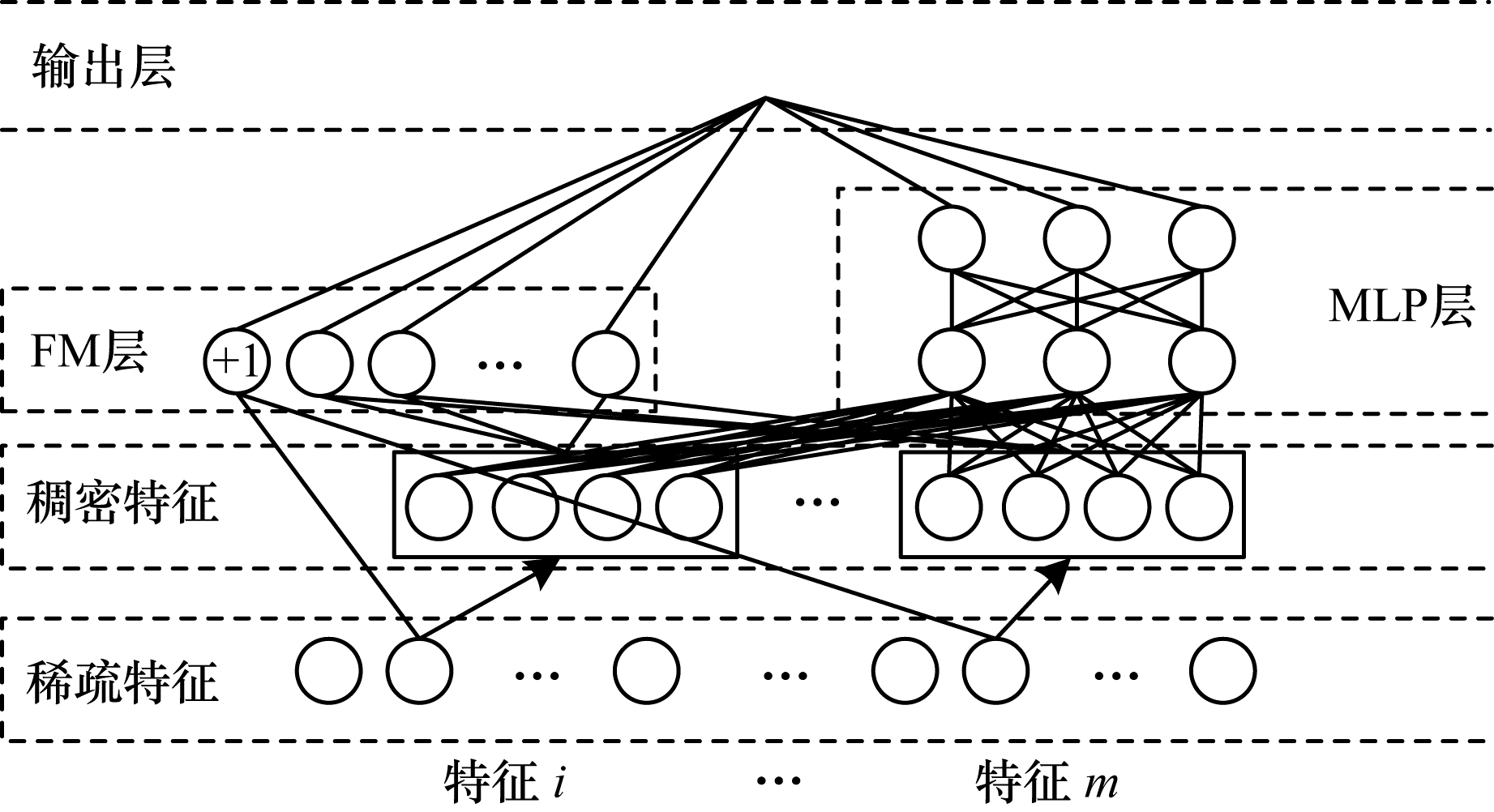

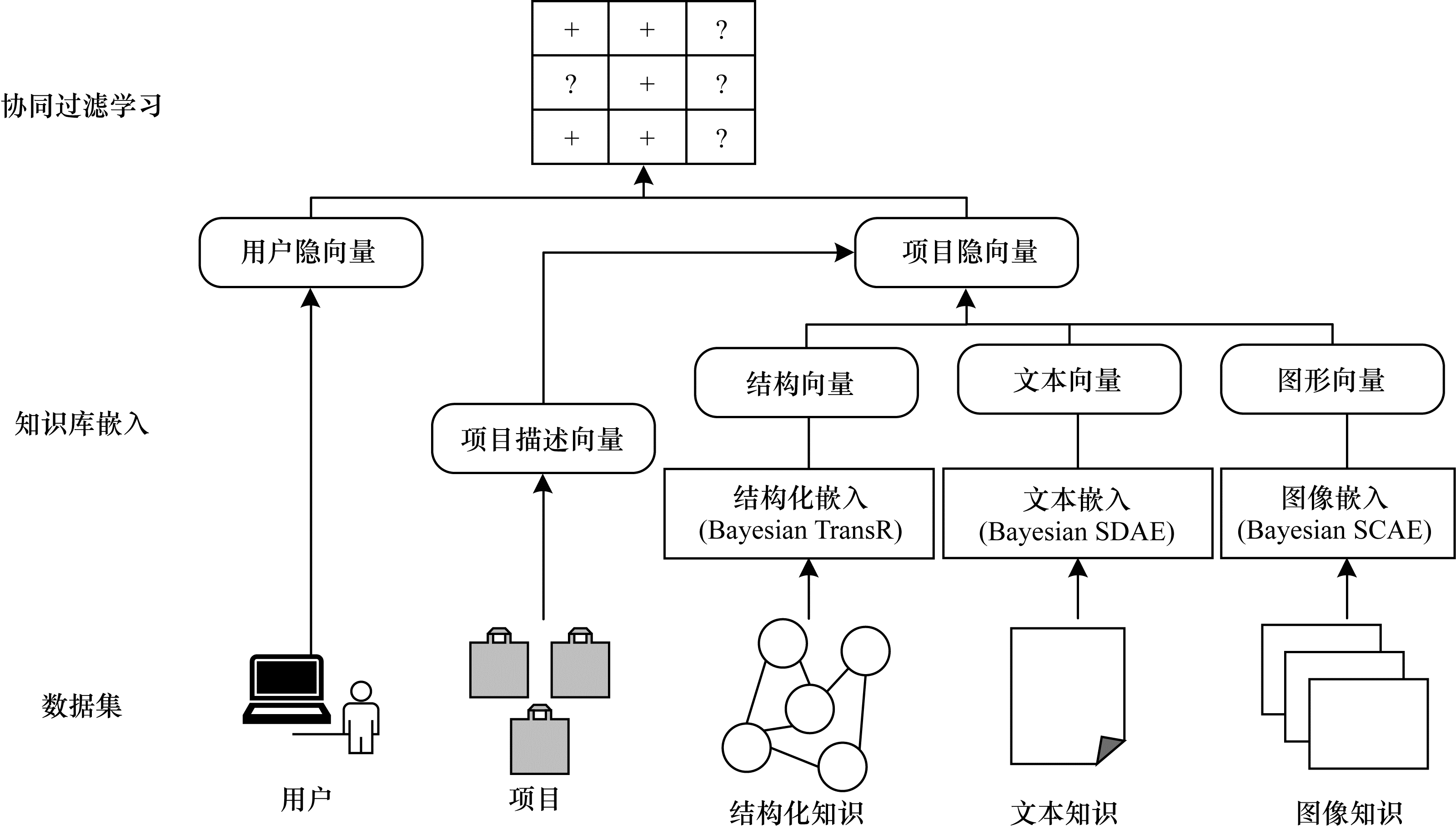

相比于传统机器学习,深度学习能够高效地学习特征之间的交叉信息。DeepFM(Deep Factorization Machine)模型[38]是一种端到端的集成学习模型,能够同时学习高维和低维交叉特征,包含了因子分解机(Factorization Machine,FM)和MLP 2个模型。其中,FM模型学习线性的低维特征交互信息,MLP模型学习非线性的高维特征交互信息。相比于Wide & Deep的模型架构,DeepFM模型并不需要琐碎的人工特征工程,利用FM模型实现了Wide模型的功能。图 4为DeepFM的模型架构,常应用于点击率(Click-Through Rate,CTR)预测。

|

Download:

|

| 图 4 DeepFM模型结构 Fig. 4 DeepFM model structure | |

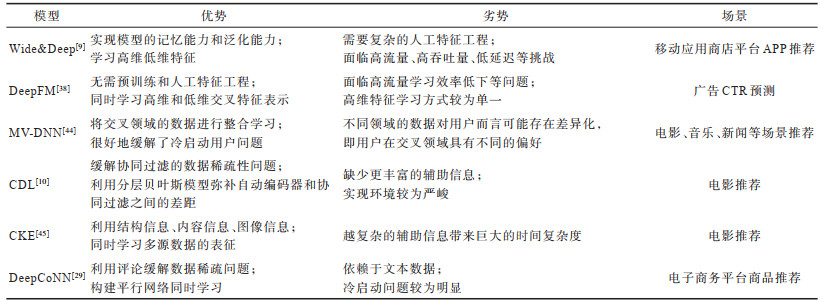

除此之外,ZHANG等[41]提出的FM支撑神经网络(Factorization Machine Supported Neural Network,FNN)和QU等[42]提出的基于产品的神经网络(Product-based Neural Network,PNN)也是点击率预测场景下的经典深度模型。表 2对上述模型进行了对比分析,可以发现DeepFM模型在同时学习高维和低维特征时避免了对时间损耗较高的操作。但是,该模型的学习效率在高流量下仍然表现不佳,且对高维特征的学习方式较为单一。

|

下载CSV 表 2 CTR预测的深度模型比较 Table 2 Comparison of deep models for CTR prediction |

基于DeepFM模型,LIAN等[43]提出了xDeepMF模型,进一步学习数据中的显式和隐式特征交互信息。HE等[37]直接利用MLP实现特征的二阶交叉学习,并且使用Dropout方法和BN(Batch Normalization)层来防止过拟合,提高模型的泛化能力。

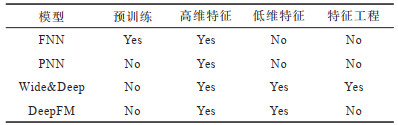

在推荐领域中,不同视角的数据可以辅助提高模型推荐效果。MV-DNN(Multi-View-Deep Neural Network)模型[44]是一种基于多视角的推荐算法,主要分为2个部分:1)学习用户或物品的隐表示;2)计算用户与物品之间的相似度。用户隐表示是基于用户信息(评论、点评、标签、喜爱偏好等)构建的用户向量;多视角构建物品隐表示是通过构建包含美食领域、运动领域等N个视角,然后从这N个视角得到N个物品向量。MV-DNN的学习误差函数如式(5)所示:

| $ {\mathcal{L}} = \mathop {\arg \min }\limits_\theta \sum\limits_{j = 1}^N {\frac{{\exp \left( {\gamma \cos \left( {{\mathit{\boldsymbol{Y}}_u}, {Y_{a, j}}} \right)} \right)}}{{\sum\limits_{X' \in {\mathit{\boldsymbol{R}}^{da}}} {\exp \left( {\gamma \cos \left( {{\mathit{\boldsymbol{Y}}_u}, {f_a}\left( {X'} \right)} \right)} \right)} }}} $ | (5) |

γ为平滑系数;a表示样本索引;

ELKAHKY等[44]基于交叉领域提出的MV-DNN模型存在如下局限性:假设用户在不同领域下的喜好偏爱相似,那么MV-DNN是一种推荐性能极佳的推荐方法。因此,MV-DNN模型需要利用先验知识来佐证不同领域之间的相关性,才能进行有效的推荐。MV-DNN的模型结构如图 5所示。

|

Download:

|

| 图 5 MV-DNN模型结构 Fig. 5 MV-DNN model structure | |

自动编码器(AE)是一种学习低维特征表示的有效工具,可以学习更丰富的特征信息,在推荐系统中得到了广泛的应用。在推荐领域,自动编码器和协同过滤方法的结合应用可以有效地缓解数据稀疏问题。

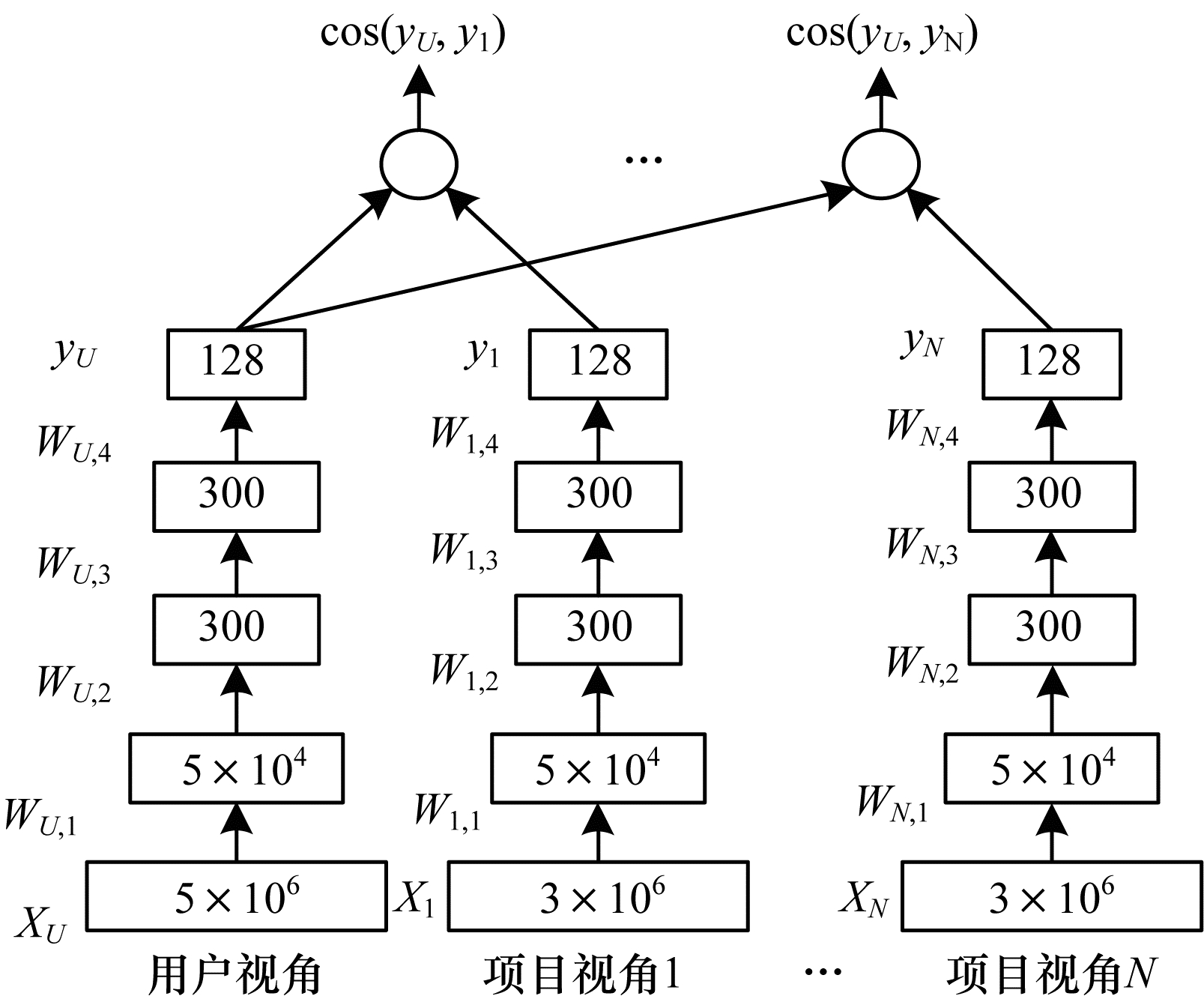

协同深度学习(Collaborative Deep Learning,CDL)模型[10]是一个经典的混合推荐模型,有效地结合了堆栈降噪自动编码器(Stacked Denoising Auto-Encoder,SDAE)和概率矩阵分解(Probabilistic Matrix Factorization,PMF)方法。SDAE在整个模型中负责整合辅助内容信息,与PMF的结合有效地平衡了辅助信息和交互数据的影响,提高了模型的推荐准确率。该模型较好地缓解了协同过滤中的稀疏问题,且弥补了自动编码器和协同过滤之间的差距。但是,模型的实现环境严峻,对辅助信息的依赖使模型的负载面临挑战。基于上述模型,ZHANG等[45]提出了协同知识库嵌入(Collaborative Knowledge Base Embedding,CKE)模型。图 6所示为CKE的模型结构,该模型融合了3种类型的辅助信息。为了充分学习辅助信息特征,模型分别运用了贝叶斯嵌入模型(TransR)学习结构信息的向量表示、贝叶斯堆栈降噪自编码器(SDAE)学习文本信息的向量表示、贝叶斯堆栈卷积自编码器(Stacked Convolutional Auto-Encoder,SCAE)学习图像信息的向量表示。

|

Download:

|

| 图 6 CKE模型结构 Fig. 6 CKE model structure | |

此外,有研究人员[46-47]利用结构信息实现推荐。WANG等[48]学习文本信息集成协同过滤算法来实现推荐。HE等[49]将图像特征应用于矩阵分解推荐模型中。相比于上述研究,CKE模型同时学习多模态数据的特征表示,在推荐性能上有显著的提升。但是,该模型运用了更丰富的多模态辅助信息,使模型的训练过程非常耗时。

3.3 基于卷积神经网络的应用卷积神经网络(CNN)在推荐系统中主要用于特征提取,在处理非结构、多源异构数据时具有较高的应用价值。

深度协同神经网络(Deep Cooperative Neural Network,DeepCoNN)模型[29]是一个基于CNN构建用户、物品隐表示的推荐模型。该模型构建了2个平行CNN来学习丰富的语义信息,缓解了数据稀疏性问题,同时利用词嵌入技术构建文本向量,保留了文本的序列信息。2个平行CNN分别学习用户特征和物品特征,并将输出结果作为预测层的输入。预测层首先使用了FM模型来学习特征交互信息,然后实现评分的预测。该模型存在2个比较明显的缺陷:对文本数据的要求较高与冷启动问题。CATHERINE等[50]基于DeepCoNN模型增加了一个隐含层来表征目标用户的用户-目标-物品数据序列,解决了DeepCoNN模型在测试集中过分依赖文本数据的问题。KIM等[51]提出的卷积矩阵分解(Convolutional Matrix Factorization,ConvMF)模型具有与CDL类似的模型结构,而该模型使用CNN来学习高维特征隐表示。相比于CDL模型,ConvMF模型借助卷积核计算和词嵌入技术能够提取更加准确的文本特征,从而提高模型的推荐准确率。为了进一步获取时序信息特征,ZHANG等[52]提出了基于混合CNN和RNN的推文话题推荐模型,对包含相关图文的推特(Twitter)进行分析。该模型通过CNN提取图片信息特征,根据LSTM(Long Short-Term Memory)网络学习Twitter中的内容信息特征,利用注意力机制平衡内容信息和图像信息对模型的权重价值。基于单个模型的特征学习模型在推荐结果准确率上表现不佳,而多模型的组合应用不仅提高了模型准确率,而且在一定程度上提高了模型的可解释性。

近年来,传统机器学习算法与深度学习算法相结合提高了深度学习模型的可解释性,而且在模型性能方面也有不错的提升。ROSEWELT等[53]将新的嵌入特征选择方法和决策树相结合应用于内容推荐系统中,该决策树是一种结合卷积神经网络分类器的模糊决策树。该模型在获得优化的特征子集后,首先在CNN和决策树的学习过程中识别出准确的内容信息,然后为用户推荐准确的物品内容。

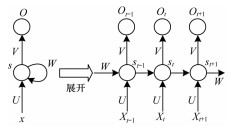

3.4 基于循环神经网络的应用循环神经网络(RNN)是学习数据时序关系的有效工具。在推荐领域中,RNN主要用于捕获用户的长期偏好演化表征和短期偏好表征。

DAI等[54]提出共同演化模型,能够捕捉用户和物品的演化隐表示。在该模型中,用户和物品之间的历史交互信息是驱使用户偏好和物品状态发生变化的关键数据。基于此,作者利用循环神经网络(RNN)学习用户和物品的动态特征表示,但是单个RNN在学习更复杂的演化表征时性能不佳。为了更好地学习动态表征,WU等[55]提出了循环推荐网络(RRN)模型。该模型作为基于RNN的非参推荐模型,使用了2个LSTM网络分别学习用户偏好的时序变化和物品的季节性演变。为了考虑用户的长期偏好和物品的静态属性,该模型同时学习了用户和物品的静态隐表示。具体预测公式如下:

| $ {\hat r_{ui|t}} = f\left( {{\mathit{\boldsymbol{u}}_{ut}}, {\mathit{\boldsymbol{v}}_{it}}, {\mathit{\boldsymbol{u}}_u}, {\mathit{\boldsymbol{v}}_i}} \right) $ | (6) |

其中:

门控循环单元(GRU)[56]是一种RNN的拓展技术,在学习句法结构上有更显著的效果,因此在推荐领域中得到了广泛的应用。BANSAL等[57]使用GRU对文本序列进行编码,构建潜因子模型,缓解了冷启动问题。此外,作者使用多任务正则化预防过拟合问题,缓解了数据稀疏性。LI等[58]构建了一个多任务学习结构NRT,在实现评分预测的同时为用户生成建议信息。该模型的优势表现为以下2点:1)模型中的文本生成机制提高了系统可解释性;2)多任务学习结构使整个模型能够在端到端的结构中高效地进行训练。

在内容推荐中,RNN是数据分析的关键工具,结合多任务学习等优秀结构可以更好地挖掘数据特征,被广泛应用于音乐推荐、视频推荐等即时推荐场景。

表 3所示为6种典型推荐模型的对比分析。

|

下载CSV 表 3 典型推荐模型的对比分析 Table 3 Comparative analysis of typical recommendation models |

上文从4个角度介绍了深度学习的应用现状,此外,还有许多不同深度学习模型的应用研究成果。从2007年至今,每年RecSys会议的召开持续为学术界和工业界贡献了最新的研究成果。

CHEN等[59]为了提高推荐系统可解释性,提出一种基于共同注意力机制的多任务学习模型(CAML)。该模型设计了一种编码-选择-解码架构,包含了编码器、多指针共同注意选择器、多任务解码器等3个部分。编码器负责学习用户或物品信息的向量表示;多指针共同注意选择器通过分层注意力模型学习用户和物品的交互关键信息特征;多任务解码器负责预测评分,同时为用户提供个性化解释。CAML方法中提及的多任务学习(Multi-Task Learning,MTL)模型[57]已经被广泛应用于推荐应用程序中,但是在现实应用场景下,多任务之间存在复杂的相关性,影响了MTL的推荐性能。基于此,TANG等[60]提出一种新型共享结构设计的渐进分层提取(PLE)模型。该模型采用渐进式路由机制逐步提取和分离更深层的语义知识,从而提高了跨任务的学习效率。该模型可以应用于多种场景中,已经被成功部署到腾讯(Tencent)的在线视频推荐系统中。

在内容推荐中,上下文一直是推荐系统的研究热点之一,比如在线音乐领域,音乐之间的相关性高度依赖于上下文。HANSEN等[61]基于上下文对用户的偏好进行建模,提出了CoSeRNN(Contextual and Sequential Recurrent Neural Network)模型。该模型以每一次对话(session)将用户偏好建模成嵌入序列,在session开始时增加用户历史行为和上下文预测用户偏好。然后将预测结果用于下游任务,通过近似最近邻搜索算法[62],高效地生成与上下文相关的即时推荐。在语境信息中,常常存在人气偏见,为了消除偏见信息,ZHOU等[63]提出一种新型的双头注意力融合自动编码器(TAFA)模型。该模型同时学习用户评论信息和用户隐式反馈的深层特征,包含了偏好编码器、评论编码器、早融合、后融合模型、双头解码器等。偏好编码器负责学习用户物品的历史交互特征;评论编码器负责挖掘评论中的语境信息;早融合模型负责将隐式反馈数据融入到提取的评论信息中,形成基于语境的评论用户向量,然后基于注意力机制将该向量与偏好用户向量进行融合,使得重要评论的选择不仅仅依赖于评论内容;后融合模型通过跨模态注意力机制融合评论用户向量和偏好用户向量;双头解码器部分主要利用了噪声对比估计(NCE)方法[64]来区分观察到的数据和人工产生的噪声数据,增加观察信息交互的可能性,同时降低基于人气的噪声分布数据。该模型使用的多阶段融合模块,对比AutoRec[11]、CDAE[65]、VAE-CF[66]等一系列基于自动编码器的模型,取得了更优的推荐效果。

4 未来研究方向近年来的研究为深度学习在推荐系统的应用奠定了坚实的基础,推荐系统的研究不再局限于准确率等指标问题,而是关心实际应用场景的推荐效果[67-69]。本节概述基于深度学习内容推荐的8个有前景的研究方向:

1)用户和物品辅助信息的联合表征学习。随着大数据应用的普遍,基于用户或物品的辅助信息表现为多源异构化。推荐算法利用这类信息来学习物品的特性和用户的偏好,可以实现更加准确的推荐。此外,深度学习处理多源异构数据的独特能力,为推荐具有视觉、音频、视频等非结构化数据提供了更多的机会。基于此,如何设计一个有效利用其他数据模式进行联合表征学习的神经体系结构[10, 45, 70]成为提高推荐性能的一个未来研究方向。

2)深度模型的可解释性。在推荐系统的应用发展中,推荐不仅是提供一个结果,还需要一些合适的理由,而深度学习表现为一种端到端的学习结构,缺少复杂的推理过程,很难对推荐的结果给出合理的解释。因此,如何提高深度神经网络的可解释性是一项艰巨的任务。提高模型的可解释性的重要意义主要体现于2个方面:(1)通过更准确的推荐结果,加强用户的满意度,提高用户对系统的信任程度;(2)使模型变得更加透明,便于研究人员持续优化模型[48]。近年来,注意力机制为推荐算法的研究开拓了新的方向[71],被广泛应用于MLP、CNN、RNN等深度学习模型中。注意力机制下的推荐模型[72-74]不仅提高了模型的推荐性能,而且提高了其可解释性。文献[73]提出了一种针对评论进行推理的注意力结构,并表示不同的推荐情境需要构建不同的推理模式。文献[74]针对元路径构建了一个神经注意力模型,通过用户和物品在元路径的交互,增强了模型对于用户和物品表征学习能力,提高了模型可解释性。一个模型的可解释能力高度依赖于对内容信息的提取,以内容信息进行推理构建注意力机制是未来研究的一个热点之一。

3)交叉领域的应用。目前,大型公司都会为用户提供多元化的产品或服务,比如“字节跳动”为用户提供短视频服务、新闻服务、影音服务等;用户可以在“淘宝”购买衣物、食物、电子设备等。单一领域的推荐效果无法综合其他领域的用户偏好,进一步加剧了数据稀疏性和冷启动问题[75]。因此,交叉领域的推荐系统可以利用多领域的辅助数据提高目标领域的推荐性能。交叉领域推荐的研究方向之一为知识转换,旨在将其他领域的知识用于改进目标领域的学习效果[76-77]。由于深度学习擅长学习数据的深层表示,能够捕捉不同领域数据的泛化和差异,并呈现出更优的推荐效果,因此交叉领域的推荐方法应用是未来推荐系统发展的研究热点之一。

4)在线推荐。随着用户需求复杂化,基于用户历史偏好的离线推荐限制了即时推荐场景下的推荐性能[13]。用户的需求时刻发生变化,使在线推荐成为了推荐系统的重要研究方向之一。近年来,基于在线推荐的研究成果频出,文献[78]基于音乐推荐提出了基于Bandits的在线推荐模型。文献[14]基于在线学习环境提出了Cascade Hybrid方法,提高了内容相关性排名准确率,且结果多样化。

5)多任务学习。在计算机视觉、自然语言处理等领域,多任务学习已得到了广泛的应用[23, 79]。在推荐领域中,多项研究成果[57, 59-60, 80]成功地将多任务学习结构应用于深度学习中,相比单任务学习取得了不错的性能提升。多任务学习的应用在深度推荐模型中的优势表现为:(1)可以防止过拟合;(2)提高模型可解释性;(3)解决推荐系统中的数据稀疏问题。

6)更深层的神经网络。从以往的研究[12, 30, 65]可以发现,大部分的深度推荐模型都是在神经网络层数为3层、4层时趋于稳定。在推荐任务中,大部分浅层网络的表现性能优于深层网络。因此,在探究基于深度学习的推荐系统背景下,越多的网络层数是否能够带来真正的性能提升,而如何有效地训练更深层次的网络结构是一项艰巨的任务。

7)强化学习的应用。近年来,Bandits算法[58]等强化学习的应用能够有效地解决冷启动问题和探索开发(EE)问题,已经被广泛地应用于推荐领域。强化学习技术与在线推荐、上下文推荐等方法的结合应用已经展现出优越的推荐性能[81-82]。深度学习提高了强化学习的实用性,并使其能够对辅助信息进行建模来设计实时推荐策略。

8)深度推荐模型的可拓展性。大数据时代下的数据量不断迭代增加,对现实世界的应用提出了挑战[83]。在推荐领域中,推荐模型的实用性至关重要,时间复杂度也是选择模型的主要考虑因素之一。随着GPU计算能力的提高,深度学习在大数据分析中是非常重要的一种有效工具。为了提高模型的可拓展性,有3个方向值得进一步研究:(1)如何针对非平稳和流式数据的增量学习;(2)如何提高高维向量和多模态数据的计算效率;(3)如何平衡模型的复杂性、拓展性、参数的指数增长等问题。

5 结束语深度学习凭借其强大的表征学习模式为推荐算法的研究与发展提供了新的解决方案。本文基于深度学习的应用阐述深度推荐算法的研究进展,对多种经典的推荐算法进行对比分析,并给出未来研究展望。深度学习相比传统推荐模型具有非线性转换、深层特征学习等优势,能够有效地挖掘图像等多源异构数据,在实际应用中具备较好的数据拟合和泛化能力,但存在可解释性较弱、学习效率低下等问题,而传统推荐模型在某些数据集上也能取得较好的性能评价,在实际场景下具有较好的推荐解释能力和时间复杂度。因此,后续将针对模型的可解释性、学习效率、可拓展性等问题进行深入研究,促进深度推荐算法在联合特征学习、多任务学习、交叉领域学习等场景的应用与发展。

| [1] |

MARZ N, WARREN J. Big data: principles and best practices of scalable real-time data systems[M]. New York, USA: Manning Publications Co., 2015.

|

| [2] |

LIU Q W. Research on recommendation algorithm based on collaborative filtering[D]. Hefei: University of Science and Technology of China, 2013. (in Chinese) 刘青文. 基于协同过滤的推荐算法研究[D]. 合肥: 中国科学技术大学, 2013. |

| [3] |

GOLDBERG D, NICHOLS D, OKI B M, et al. Using collaborative filtering to weave an information tapestry[J]. Communications of the ACM, 1992, 35(12): 61-70. DOI:10.1145/138859.138867 |

| [4] |

RESNICK P, VARIAN H R. Recommender systems[J]. Communications of the ACM, 1997, 40(3): 56-58. DOI:10.1145/245108.245121 |

| [5] |

MAHMOOD T, RICCI F. Improving recommender systems with adaptive conversational strategies[C]//Proceedings of the 20th ACM Conference on Hypertext and Hypermedia. New York, USA: ACM Press, 2009: 73-82.

|

| [6] |

BURKE R. Hybrid Web recommender systems[M]. Berlin, Germany: Springer, 2007.

|

| [7] |

ZHU Y Y, SUN J. Research progress of recommender system[J]. Computer Science and Exploration, 2015, 9(5): 513-525. (in Chinese) 朱扬勇, 孙婧. 推荐系统研究进展[J]. 计算机科学与探索, 2015, 9(5): 513-525. |

| [8] |

LINDEN G, SMITH B, YORK J. Amazon.com recommendations: item-to-item collaborative filtering[J]. IEEE Internet Computing, 2003, 7(1): 76-80. DOI:10.1109/MIC.2003.1167344 |

| [9] |

CHENG H T, KOC L, HARMSEN J, et al. Wide and deep learning for recommender systems[C]//Proceedings of the 1st IEEE Workshop on Deep Learning for Recommender Systems. Washington D.C., USA: IEEE Press, 2016: 7-10.

|

| [10] |

WANG H, WANG N, YEUNG D Y. Collaborative deep learning for recommender systems[C]//Proceedings of the 21th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York, USA: ACM Press, 2015: 1235-1244.

|

| [11] |

SEDHAIN S, MENON A K, SANNER S, et al. Autorec: autoencoders meet collaborative filtering[C]//Proceedings of the 24th IEEE International Conference on World Wide Web. Washington D.C., USA: IEEE Press, 2015: 111-112.

|

| [12] |

COVINGTON P, ADAMS J, SARGIN E. Deep neural networks for youtube recommendations[C]//Proceedings of the 10th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2016: 191-198.

|

| [13] |

SCHUTH A, OOSTERHUIS H, WHITESON S, et al. Multileave gradient descent for fast online learning to rank[C]//Proceedings of the 9th ACM International Conference on Web Search and Data Mining. New York, USA: ACM Press, 2016: 457-466.

|

| [14] |

LI C, FENG H Y, DE RIJKE M. Cascading hybrid bandits: online learning to rank for relevance and diversity[EB/OL]. [2020-12-10]. https://arxiv.org/abs/1912.00508.

|

| [15] |

ADOMAVICIUS G, TUZHILIN A. Toward the next generation of recommender systems: a survey of the state-of-the-art and possible extensions[J]. IEEE Transactions on Knowledge and Data Engineering, 2005, 17(6): 734-749. DOI:10.1109/TKDE.2005.99 |

| [16] |

BURKE R. Hybrid recommender systems: survey and experiments[J]. User Modeling and User-Adapted Interaction, 2002, 12(4): 331-370. DOI:10.1023/A:1021240730564 |

| [17] |

JANNACH D, ZANKER M, FELFERNIG A, et al. Recommender systems: an introduction[M]. [S.1.]: Cambridge University Press, 2010.

|

| [18] |

BAEZA-YATES R, RIBEIRO-NETO B. Modern information retrieval[M]. New York, USA: ACM Press, 1999.

|

| [19] |

PAZZANI M J, BILLSUS D. Content-based recommendation systems[M]. Berlin, Germany: Springer, 2007.

|

| [20] |

RENDLE S, KRICHENE W, ZHANG L, et al. Neural collaborative filtering vs. matrix factorization revisited[EB/OL]. [2020-12-10]. https://arxiv.org/abs/2005.09683.

|

| [21] |

XU Y, ZHU N. Hybrid recommendation algorithm based on long-term and short-term interest and matrix factorization for collaborative filtering[C]//Proceedings of JPCS'20. [S. l. ]: IOP Publishing, 2020: 16-24.

|

| [22] |

FENG C J, LIANG J Y, SONG P, et al. Similarity calculation based on extreme scoring behavior[J]. Computer Science, 2020, 47(2): 31-36. (in Chinese) 冯晨娇, 梁吉业, 宋鹏, 等. 基于极端评分行为的相似度计算[J]. 计算机科学, 2020, 47(2): 31-36. |

| [23] |

DENG L, YU D. Deep learning: methods and applications[J]. Foundations and Trends in Signal Processing, 2014, 7(3/4): 197-387. |

| [24] |

GOODFELLOW I, BENGIO Y, COURVILLE A, et al. Deep learning[M]. Cambridge, USA: MIT Press, 2016.

|

| [25] |

BILLSUSE D, PAZZANI M J. Learning collaborative information filters[C]//Proceedings of IEEE ICML'98. Washington D.C., USA: IEEE Press, 1998: 46-54.

|

| [26] |

WANG J H. Research on sparsity of label-based collaborative filtering[D]. Hefei: University of Science and Technology of China, 2011. (in Chinese) 王金辉. 基于标签的协同过滤稀疏性问题研究[D]. 合肥: 中国科学技术大学, 2011. |

| [27] |

SCHEIN A I, POPESCUL A, UNGAR L H, et al. Methods and metrics for cold-start recommendations[C]//Proceedings of the 25th Annual International ACM SIGIR Conference on Research and Development in Information Retrieval. New York, USA: ACM Press, 2002: 253-260.

|

| [28] |

WU H, WANG X J, BAN L, et al. Multi-source heterogeneous data query middleware based on LINQ[J]. Computer Engineering, 2011, 37(2): 1-3. (in Chinese) 吴焕, 王晓箴, 潘林, 等. 基于LINQ的多源异构数据查询中间件[J]. 计算机工程, 2011, 37(2): 1-3. |

| [29] |

ZHENG L, NOROOZI V, YU P S. Joint deep modeling of users and items using reviews for recommendation[C]//Proceedings of the 20th ACM International Conference on Web Search and Data Mining. New York, USA: ACM Press, 2017: 425-434.

|

| [30] |

HE X, LIAO L, ZHANG H, et al. Neural collaborative filtering[C]//Proceedings of the 26th International Conference on World Wide Web. Perth, Australia: [s. n. ], 2017: 173-182.

|

| [31] |

HORNIK K. Approximation capabilities of multilayer feedforward networks[J]. Neural Networks, 1991, 4(2): 251-257. DOI:10.1016/0893-6080(91)90009-T |

| [32] |

HORNIK K, STINCHCOMBE M, WHITE H. Multilayer feedforward networks are universal approximators[J]. Neural Networks, 1989, 2(5): 359-366. DOI:10.1016/0893-6080(89)90020-8 |

| [33] |

CHEN M, XU Z, WEINBERGER K, et al. Marginalized denoising autoencoders for domain adaptation[EB/OL]. [2020-12-10]. https://arxiv.org/ftp/arxiv/papers/1206/1206.4683.pdf.

|

| [34] |

LECUN Y, BOSER B, DENKER J S, et al. Backpropagation applied to handwritten zip code recognition[J]. Neural Computation, 1989, 1(4): 541-551. DOI:10.1162/neco.1989.1.4.541 |

| [35] |

LECUN Y, BOTTOU L, BENGIO Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11): 2278-2324. DOI:10.1109/5.726791 |

| [36] |

KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[J]. Communications of the ACM, 2017, 60(6): 84-90. DOI:10.1145/3065386 |

| [37] |

HE X, CHUA T S. Neural factorization machines for sparse predictive analytics[C]//Proceedings of the 40th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York, USA: ACM Press, 2017: 355-364.

|

| [38] |

GUO H F, TANG R M, YE Y M, et al. DeepFM: a factorization-machine based neural network for CTR prediction[EB/OL]. [2020-12-10]. https://arxiv.org/abs/1703.04247.

|

| [39] |

CHEN C, ZHAO P, LI L, et al. Locally connected deep learning framework for industrial-scale recommender systems[C]//Proceedings of the 26th IEEE International Conference on World Wide Web Companion. Washington D.C., USA: IEEE Press, 2017: 769-770.

|

| [40] |

ALASHKAR T, JIANG S, WANG S, et al. Examples-rules guided deep neural network for makeup recommendation[C]//Proceedings of AAAI Conference on Artificial Intelligence. [S. 1. ]: AAAI Press, 2017: 941-947.

|

| [41] |

ZHANG W, DU T, WANG J. Deep learning over multi-field categorical data[C]//Proceedings of European Conference on Information Retrieval. Berlin, Germany: Springer, 2016: 45-57.

|

| [42] |

QU Y R, CAI H, REN K, et al. Product-based neural networks for user response prediction[EB/OL]. [2020-12-10]. https://arxiv.org/abs/1611.00144.

|

| [43] |

LIAN J, ZHOU X, ZHANG F, et al. xDeepFM: combining explicit and implicit feature interactions for recommender systems[C]//Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York, USA: ACM Press, 2018: 1754-1763.

|

| [44] |

ELKAHKY A M, SONG Y, HE X. A multi-view deep learning approach for cross domain user modeling in recommendation systems[C]//Proceedings of the 24th IEEE International Conference on World Wide Web. Washington D.C., USA: IEEE Press, 2015: 278-288.

|

| [45] |

ZHANG F, YUAN N J, LIAN D, et al. Collaborative knowledge base embedding for recommender systems[C]//Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York, USA: ACM Press, 2016: 353-362.

|

| [46] |

NGUYEN P, TOMEO P, DI NOIA T, et al. An evaluation of SimRank and personalized PageRank to build a recommender system for the web of data[C]//Proceedings of the 24th IEEE International Conference on World Wide Web. Washington D.C., USA: IEEE Press, 2015: 1477-1482.

|

| [47] |

YU X, REN X, SUN Y, et al. Personalized entity recommendation: a heterogeneous information network approach[C]//Proceedings of the 7th ACM International Conference on Web Search and Data Mining. New York, USA: ACM Press, 2014: 283-292.

|

| [48] |

WANG C, BLEI D M. Collaborative topic modeling for recommending scientific articles[C]//Proceedings of the 17th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York, USA: ACM Press, 2011: 448-456.

|

| [49] |

HE R N, MCAULEY J. VBPR: visual Bayesian personalized ranking from implicit feedback[EB/OL]. [2020-12-10]. https://arxiv.org/abs/1510.01784.

|

| [50] |

CATHERINE R, COHEN W. TransNets: learning to transform for recommendation[C]//Proceedings of the 11th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2017: 288-296.

|

| [51] |

KIM D, PARK C, OH J, et al. Convolutional matrix factorization for document context-aware recommendation[C]//Proceedings of the 10th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2016: 233-240.

|

| [52] |

ZHANG Q, WANG J, HUANG H, et al. Hashtag recommendation for multimodal Microblog using co-attention network[C]//Proceedings of the 23rd International Joint Conference on Artificial Intelligence. Washington D.C., USA: IEEE Press, 2017: 3420-3426.

|

| [53] |

ROSEWELT L A, RENJIT J A. A content recommendation system for effective e-learning using embedded feature selection and fuzzy DT based CNN[J]. Journal of Intelligent and Fuzzy Systems, 2020, 39(8): 1-14. |

| [54] |

DAI H, WANG Y, TRIVEDI R, et al. Recurrent coevolutionary latent feature processes for continuous-time recommendation[C]//Proceedings of the 1st IEEE Workshop on Deep Learning for Recommender Systems. Washington D.C., USA: IEEE Press, 2016: 29-34.

|

| [55] |

WU C Y, AHMED A, BEUTEL A, et al. Recurrent recommender networks[C]//Proceedings of the 10th ACM International Conference on Web Search and Data Mining. New York, USA: ACM Press, 2017: 495-503.

|

| [56] |

CHO K, VAN MERRIENBOER B, BAHDANAU D, et al. On the properties of neural machine translation: encoder-decoder approaches[EB/OL]. [2020-12-10]. https://arxivarxiv:1409.1259.

|

| [57] |

BANSAL T, BELANGER D, MCCALLUM A. Ask the GRU: multi-task learning for deep text recommendations[C]//Proceedings of the 10th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2016: 107-114.

|

| [58] |

LI P, WANG Z, REN Z, et al. Neural rating regression with abstractive tips generation for recommendation[C]//Proceedings of the 40th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York, USA: ACM Press, 2017: 345-354.

|

| [59] |

CHEN Z, WANG X, XIE X, et al. Co-attentive multi-task learning for explainable recommendation[C]//Proceedings of IEEE IJCAI'19. Washington D.C., USA: IEEE Press, 2019: 2137-2143.

|

| [60] |

TANG H, LIU J, ZHAO M, et al. Progressive Layered Extraction(PLE): a novel multi-task learning model for personalized recommendations[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 269-278.

|

| [61] |

HANSEN C, HANSEN C, MAYSTRE L, et al. Contextual and sequential user embeddings for large-scale music recommendation[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 53-62.

|

| [62] |

SI P. Approximate nearest neighbour search with the fukunaga & narendra algorithm[D]. Barcelona, Spain: Polytechnic University of Catalonia, 2011.

|

| [63] |

ZHOU J P, CHENG Z, PEREZ F, et al. TAFA: two-headed attention fused autoencoder for context-aware recommendations[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 338-347.

|

| [64] |

WU G, VOLKOVS M, SOON C L, et al. Noise contrastive estimation for one-class collaborative filtering[C]//Proceedings of the 42nd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York, USA: ACM Press, 2019: 135-144.

|

| [65] |

WU Y, DUBOIS C, ZHENG A X, et al. Collaborative denoising auto-encoders for top-n recommender systems[C]//Proceedings of the 9th ACM International Conference on Web Search and Data Mining. New York, USA: ACM Press, 2016: 153-162.

|

| [66] |

LIANG D, KRISHNAN R G, HOFFMAN M D, et al. Variational autoencoders for collaborative filtering[C]//Proceedings of 2018 IEEE World Wide Web Conference. Washington D.C., USA: IEEE Press, 2018: 689-698.

|

| [67] |

WANG H, ZHAO Q, WU Q, et al. Global and local differential privacy for collaborative bandits[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 150-159.

|

| [68] |

TANG J, WEN H, WANG K. Revisiting adversarially learned injection attacks against recommender systems[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 318-327.

|

| [69] |

PATRO G K, CHAKRABORTY A, BANERJEE A, et al. Towards safety and sustainability: designing local recommendations for post-pandemic world[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 358-367.

|

| [70] |

ZHANG Y, AI Q, CHEN X, et al. Joint representation learning for top-n recommendation with heterogeneous information sources[C]//Proceedings of 2017 ACM Conference on Information and Knowledge Management. New York, USA: ACM Press, 2017: 1449-1458.

|

| [71] |

VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[EB/OL]. [2020-12-10]. https://arxiv.org/abs/1706.03762.

|

| [72] |

SEO S, HUANG J, YANG H, et al. Interpretable convolutional neural networks with dual local and global attention for review rating prediction[C]//Proceedings of the 11th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2017: 297-305.

|

| [73] |

TAY Y, LUU A T, HUI S C. Multi-pointer co-attention networks for recommendation[C]//Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York, USA: ACM Press, 2018: 2309-2318.

|

| [74] |

HU B, SHI C, ZHAO W X, et al. Leveraging meta-path based context for top-n recommendation with a neural co-attention model[C]//Proceedings of the 24th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York, USA: ACM Press, 2018: 1531-1540.

|

| [75] |

KHAN M M, IBRAHIM R, GHANI I. Cross domain recommender systems: a systematic literature review[J]. ACM Computing Surveys, 2017, 50(3): 1-34. |

| [76] |

FERNáNDEZ-TOBíAS I, CANTADOR I, KAMINSKAS M, et al. Cross-domain recommender systems: a survey of the state of the art[EB/OL]. [2020-12-10]. https://www.researchgate.net/publication/267227272.

|

| [77] |

PAN W, XIANG E W, LIU N N, et al. Transfer learning in collaborative filtering for sparsity reduction[C]//Proceedings of the 24th AAAI Conference on Artificial Intelligence. [S. 1. ]: AAAI Press: 2010: 230-235.

|

| [78] |

PEREIRA B L, UEDA A, PENHA G, et al. Online learning to rank for sequential music recommendation[C]//Proceedings of the 13th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2019: 237-245.

|

| [79] |

COLLOBERT R, WESTON J. A unified architecture for natural language processing: deep neural networks with multitask learning[C]//Proceedings of the 25th IEEE International Conference on Machine Learning. Washington D.C., USA: IEEE Press, 2008: 160-167.

|

| [80] |

SUTTON R S, BARTO A G. Reinforcement learning: an introduction[M]. Cambridge, USA: MIT Press, 2018.

|

| [81] |

YANG L, LIU B, LIN L, et al. Exploring clustering of bandits for online recommendation system[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 120-129.

|

| [82] |

SANTANA M R O, MELO L C, CAMARGO F H F, et al. Contextual meta-bandit for recommender systems selection[C]//Proceedings of the 14th ACM Conference on Recommender Systems. New York, USA: ACM Press, 2020: 444-449.

|

| [83] |

NAJAFABADI M M, VILLANUSTRE F, KHOSHGOFTAAR T M, et al. Deep learning applications and challenges in big data analytics[J]. Journal of Big Data, 2015, 2(1): 1-21. |

2021, Vol. 47

2021, Vol. 47